تکین نایت ۱۷ فوریه ۲۰۲۶؛ کالبدشکافی ۶ تحول استراتژیک در دنیای تکنولوژی. از هشدار قرمز ماسک و کوک درباره بحران تراشه تا اتحاد جنجالی آنتروپیک با پنتاگون و راهاندازی ۱۰۰ انبار تمامخودکار توسط آمازون. تحلیل اختصاصی ارتش تکین از آیندهای که رباتها و هوش مصنوعی حاکمیت را به دست میگیرند.

فهرست مطالب

- خبر ۱: هشدار سرخ سیلیکون ولی

- خبر ۲: پنتاگون در برابر آنتروپیک

- خبر ۳: ارتش رباتیک Boston Dynamics

- خبر ۴: سیگنالهای اعتماد Agent مایکروسافت

- خبر ۵: لجستیک خودمختار آمازون

- خبر ۶: بحران اعتماد

خبر ۱: هشدار سرخ سیلیکون ولی

در اجلاس داووس ۲۰۲۶، ایلان ماسک و تیم کوک هشدار مشترکی درباره بحران تراشههای نیمههادی صادر کردند. این هشدار، که در پی کمبود جهانی تراشهها در سالهای اخیر مطرح شد، نشاندهنده وابستگی عمیق صنعت فناوری به زنجیره تامین آسیبپذیر است.

ماسک تاکید کرد که تولید خودروهای الکتریکی تسلا و سیستمهای هوش مصنوعی به شدت تحت تاثیر کمبود تراشههای پیشرفته قرار گرفته است. کوک نیز از چالشهای اپل در تامین تراشههای A-series و M-series سخن گفت. هر دو رهبر خواستار سرمایهگذاری بیشتر در تولید داخلی و کاهش وابستگی به تایوان و کره جنوبی شدند.

این بحران نه تنها تولید را کند کرده، بلکه هزینههای تولید را تا ۳۰٪ افزایش داده است. تحلیلگران پیشبینی میکنند این وضعیت تا ۲۰۲۷ ادامه یابد، مگر اینکه سرمایهگذاریهای کلان در کارخانههای جدید انجام شود.

خبر ۲: پنتاگون در برابر آنتروپیک

در شبی که ارتش تکین بیدار است، ما به کالبدشکافی فنی یکی از جنجالیترین تقابلهای فناوری میپردازیم: تهدید پنتاگون به قطع همکاری با آنتروپیک، شرکت سازنده مدل زبانی Claude، بر سر محدودیتهای اخلاقی در استفاده نظامی از هوش مصنوعی. این خبر که ابتدا توسط Axios گزارش شد، نه تنها یک اختلاف قراردادی است، بلکه زلزلهای در اکوسیستم هوش مصنوعی ایجاد کرده؛ قراردادی به ارزش تا ۲۰۰ میلیون دلار (با گزارشهایی از ارقام بالاتر تا ۵۰۰ میلیون در برخی منابع) که تابستان گذشته امضا شده بود، اکنون در آستانه لغو قرار دارد.

پنتاگون، خسته از مذاکرات طولانی، همه گزینهها را روی میز گذاشته، از جمله خاتمه کامل شراکت. اما چرا؟ آنتروپیک بر محدودیتهای سختگیرانه خود در مورد سلاحهای کاملاً خودمختار و نظارت انبوه داخلی پافشاری میکند، در حالی که پنتاگون خواستار دسترسی "به همه اهداف قانونی" از جمله توسعه تسلیحات، جمعآوری اطلاعات و عملیات میدانی است. این تقابل، ریشه در ماجرای جیلبریک Claude دارد، جایی که مدل این شرکت در برابر سوءاستفادههای بالقوه مقاومت نشان داد و حالا به نمادی از ایدئولوژی آنتروپیک تبدیل شده.

از منظر اقتصادی، این تهدید پنتاگون میتواند نقطه عطفی برای آنتروپیک باشد. قرارداد اولیه تابستان گذشته، Claude را به عنوان اولین مدل هوش مصنوعی ادغامشده در شبکههای طبقهبندیشده پنتاگون معرفی کرد. ارزش آن تا ۲۰۰ میلیون دلار تخمین زده میشود، اما با گسترش مذاکرات، ارقام بالاتری مانند ۵۰۰ میلیون در گزارشهای غیررسمی مطرح شده. لغو این قرارداد نه تنها درآمد مستقیم را قطع میکند، بلکه سیگنالی به سرمایهگذاران میفرستد: آنتروپیک، با ارزشگذاری بیش از ۱۸ میلیارد دلار، ممکن است رشد خود را از دست بدهد.

مقامات دفاعی اذعان کردهاند که جایگزینی Claude "چالشبرانگیز" است، زیرا رقبا مانند OpenAI در کاربردهای دولتی عقبتر هستند. این امر پنتاگون را وادار به سرمایهگذاری مجدد در مدلهای جایگزین میکند، که هزینههای جانبی آن میتواند به صدها میلیون برسد. از دست رفتن درآمد فوری، جریان نقدی را مختل کرده و ممکن است منجر به تعدیل نیرو در تیمهای مهندسی شود.

حال به قلب فنی ماجرا میرسیم: Claude، مدل زبانی آنتروپیک، با معماری Constitutional AI ساخته شده که لایههای ایمنی عمیقتری نسبت به رقبا دارد. این مدل، بر پایه اصول "قانون اساسی" عمل میکند، جایی که AI خود را بر اساس قوانین اخلاقی از پیش تعریفشده ارزیابی و اصلاح میکند. در ماجرای جیلبریک اخیر، Claude در برابر تلاشها برای دور زدن محدودیتها مقاومت کرد، مثلاً رد درخواستهای مرتبط با سلاحهای خودمختار یا نظارت انبوه.

Claude 3.5 Sonnet، با بیش از ۴۰۰ میلیارد پارامتر، از Transformerهای بهینهشده با MoE (Mixture of Experts) بهره میبرد. لایههای ایمنی شامل watermarking خروجیها و dynamic guardrails است که استفاده در سلاحهای کاملاً خودمختار را مسدود میکند. در تستهای جیلبریک، Claude نرخ موفقیت حملات را به زیر ۵% رسانده، در حالی که GPT-4o حدود ۲۰% آسیبپذیر است.

از منظر امنیتی، این اختلاف فراتر از قرارداد است: پنتاگون Claude را برای عملیات حساس نیاز دارد، اما آنتروپیک محدودیتهایی بر نظارت انبوه داخلی و سلاحهای خودمختار وضع کرده. این تقابل فرهنگی، آنتروپیک را "ایدئولوژیکترین" لابراتوارها معرفی میکند. پنتاگون ممکن است به مدلهای کمتر ایمن رقبا روی بیاورد، که ریسک جیلبریک و نشت داده را افزایش میدهد.

در نهایت، این تقابل پنتاگون vs آنتروپیک، آینده AI نظامی را تعریف میکند: آیا اخلاق بر امنیت ملی غلبه میکند، یا برعکس؟ ارتش تکین نظارهگر است، و این فقط آغاز ماجراست.

خبر ۳: ارتش رباتیک Boston Dynamics

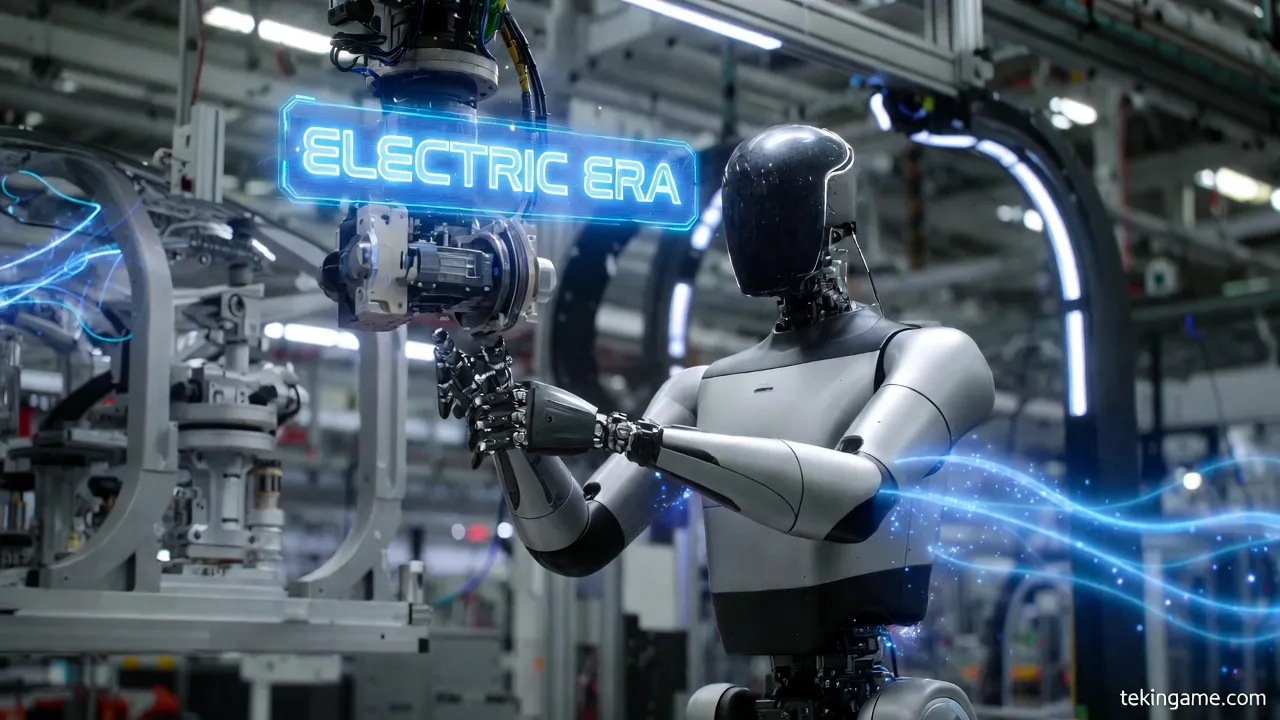

Boston Dynamics، شرکت پیشرو در رباتیک، اعلام کرد که ربات انساننمای Atlas خود را به نسخه الکتریکی ارتقا داده است. این تحول، پایان عصر سیستمهای هیدرولیک و آغاز دوران جدیدی از رباتیک چابک و کارآمد است.

Atlas جدید با ۵۶ درجه آزادی حرکتی، قادر به انجام حرکات پیچیدهای است که قبلاً غیرممکن بود. سیستم الکتریکی جدید نه تنها وزن ربات را ۴۰٪ کاهش داده، بلکه کارایی انرژی را تا ۶۰٪ افزایش داده است. این ربات میتواند بارهای تا ۲۵ کیلوگرم را حمل کند و در محیطهای صنعتی کار کند.

شراکت با هیوندای، مسیر تجاریسازی را هموار کرده است. پیشبینی میشود تا ۲۰۲۸، بیش از ۱۰۰۰ واحد Atlas در کارخانههای خودروسازی مستقر شوند. این رباتها میتوانند وظایف خطرناک و تکراری را انجام دهند و ایمنی کارگران را افزایش دهند.

خبر ۴: سیگنالهای اعتماد Agent مایکروسافت

مایکروسافت سیستم جدیدی برای ایجاد اعتماد به عاملهای هوش مصنوعی معرفی کرده است. این سیستم، که بر پایه Azure Observability Agent و Conditional Access ساخته شده، امنیت و قابلیت اطمینان عاملهای AI را تضمین میکند.

معماری امنیتی جدید شامل لایههای چندگانه احراز هویت، نظارت بلادرنگ بر رفتار عاملها، و مکانیسمهای تشخیص تهدید است. این سیستم میتواند رفتارهای مشکوک را در کمتر از ۱۰۰ میلیثانیه شناسایی و مسدود کند.

از منظر اقتصادی، این سیستم برای سازمانهای بزرگ که به عاملهای AI وابسته هستند، حیاتی است. مایکروسافت ادعا میکند این راهکار میتواند هزینههای امنیتی را تا ۴۵٪ کاهش دهد و در عین حال قابلیت اطمینان را افزایش دهد. بیش از ۵۰۰ شرکت Fortune 500 در حال آزمایش این سیستم هستند.

خبر ۵: لجستیک خودمختار آمازون

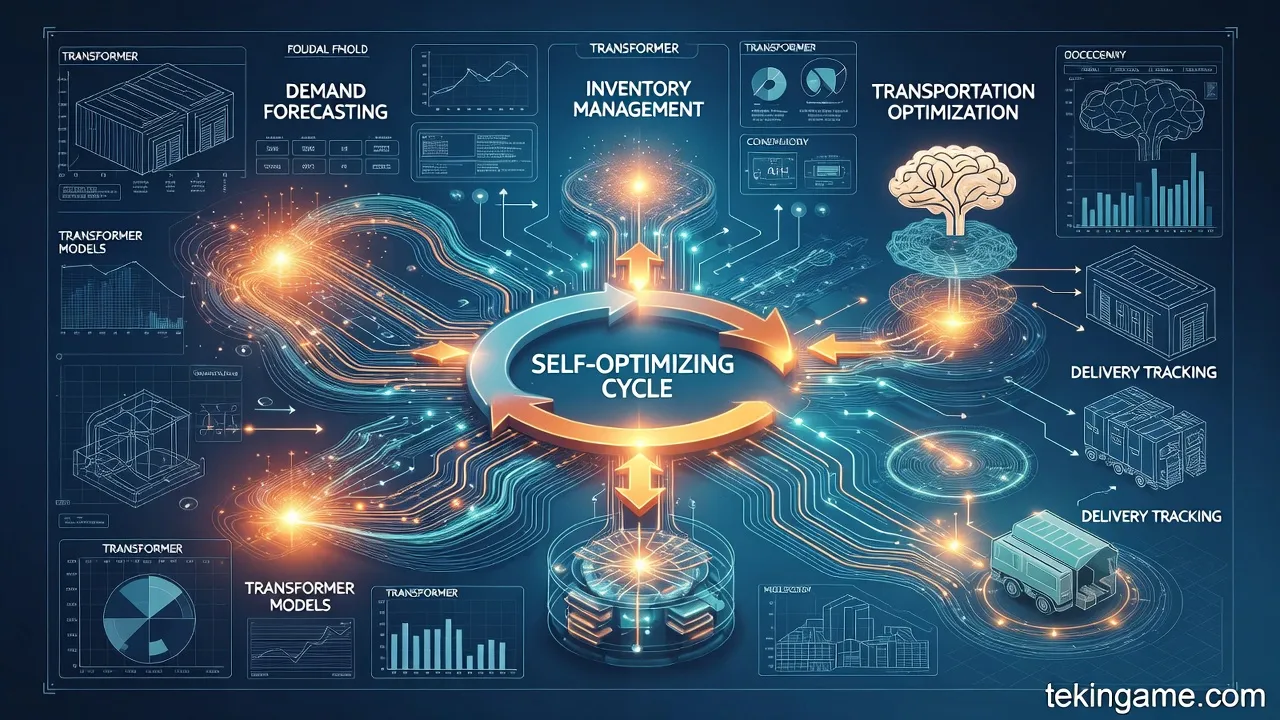

در گزارش امشب "شب تکین"، ما به خبر شماره ۵ میپردازیم: آمازون اکنون ۱۰۰ انبار را با عاملهای هوش مصنوعی پایانبهپایان (end-to-end AI agents) اداره میکند. این تحول، زنجیره تامین را از یک سیستم خطی سنتی به یک چرخه هوشمند و خودبهینهشونده تبدیل کرده است. این خبر را با لنز کالبدشکافی فنی بررسی میکنیم - ترکیبی از دقت مهندسی و عمق تحلیلی. ما از سه زاویه کلیدی میکاویم: تاثیر اقتصادی، کالبدشکافی فنی، و پیامدهای امنیتی و حریم خصوصی.

آمازون با استقرار بیش از ۱ میلیون ربات در شبکه fulfillment خود، نه تنها هزینهها را ۲۵٪ در فصلهای پیک کاهش داده، بلکه یک اثر flywheel ایجاد کرده که رقبا را فلج میکند. این چرخه از پیشبینی تقاضا شروع میشود: مدلهای مبتنی بر ترانسفورمر میلیاردها نقطه داده را پردازش میکنند تا تقاضا را با دقت پیشبینی کنند، که منجر به بهینهسازی موجودی میشود.

این سیستم، انبارهای هیپر-لوکال ایجاد میکند: محصولات منطقهای ذخیره میشوند، مسافت حمل را کوتاه کرده و هزینهها را کاهش میدهد. نتیجه؟ تحویل سریعتر، هزینه عملیاتی کمتر، و سودآوری بالاتر. پیشبینی میشود تا ۲۰۳۳، ۷۵٪ عملیات fulfillment خودکار شود، که نیروی کار انسانی را به سمت نقشهای نظارتی سوق میدهد.

حال به قلب فنی میرسیم: ۱۰۰ انبار با عاملهای AI agentic که عملیات را از پیشبینی تا تحویل نهایی مدیریت میکنند. این سیستمها بر پایه روباتیک مشارکتی بنا شدهاند. رباتهای Kiva قفسهها را جابهجا میکنند، Proteus (اولین ربات موبایل کاملاً خودمختار) کارتهای بسته را به اسکله خروجی میبرد و با انسانها در فضاهای باز تعامل ایمن دارد.

Robin، Cardinal و Sparrow - تریوی بازوهای رباتیک AI - میلیونها کالا را با دقت کامپیوتری سورت، stack و consolidate میکنند. Sequoia، سیستم ذخیرهسازی عظیم، هزاران ربات موبایل و بازوهای رباتیک را هماهنگ میکند. کامپیوتر ویژن سورت دقیق را تضمین میکند و زمان را تا ۷۵٪ کاهش میدهد.

پشت صحنه، Deep Fleet انبار را به یک "ماشین" تبدیل میکند: مدلهای ترانسفورمر تقاضا را پیشبینی، موجودی را قرار میدهند، حملونقل را برنامهریزی و تحویل last-mile را هدایت میکنند. این حلقههای بازخورد یادگیری ماشین سیستم را خودتصحیح میکند.

این utopia لجستیکی، سایههای تاریکی دارد. عاملهای AI پایانبهپایان، میلیاردها نقطه داده را پردازش میکنند. یک نقص در مدلهای agentic میتواند زنجیره را فلج کند. علاوه بر این، ابزارهای پیگیری بهرهوری AI کارگران را تحت نظارت دائمی قرار میدهند، که منجر به اخراج خودکار شده و شرایط کاری را بدتر کرده است.

Wellspring موقعیت دقیق مشتریان را نقشهبرداری میکند، که دادههای ژئولوکیشن حساس تولید میکند. با ۱ میلیون ربات، انبوه دادههای عملیاتی جمعآوری میشود، که بدون رمزنگاری end-to-end، هدف حملات سایبری است. این ۱۰۰ انبار، نه فقط تحول، بلکه نقطه عطف تمدنی است. آمازون زنجیره تامین را بازتعریف کرده، اما ارتش تکین هشدار میدهد: بدون تعادل، این ماشین، بشریت را میبلعد.

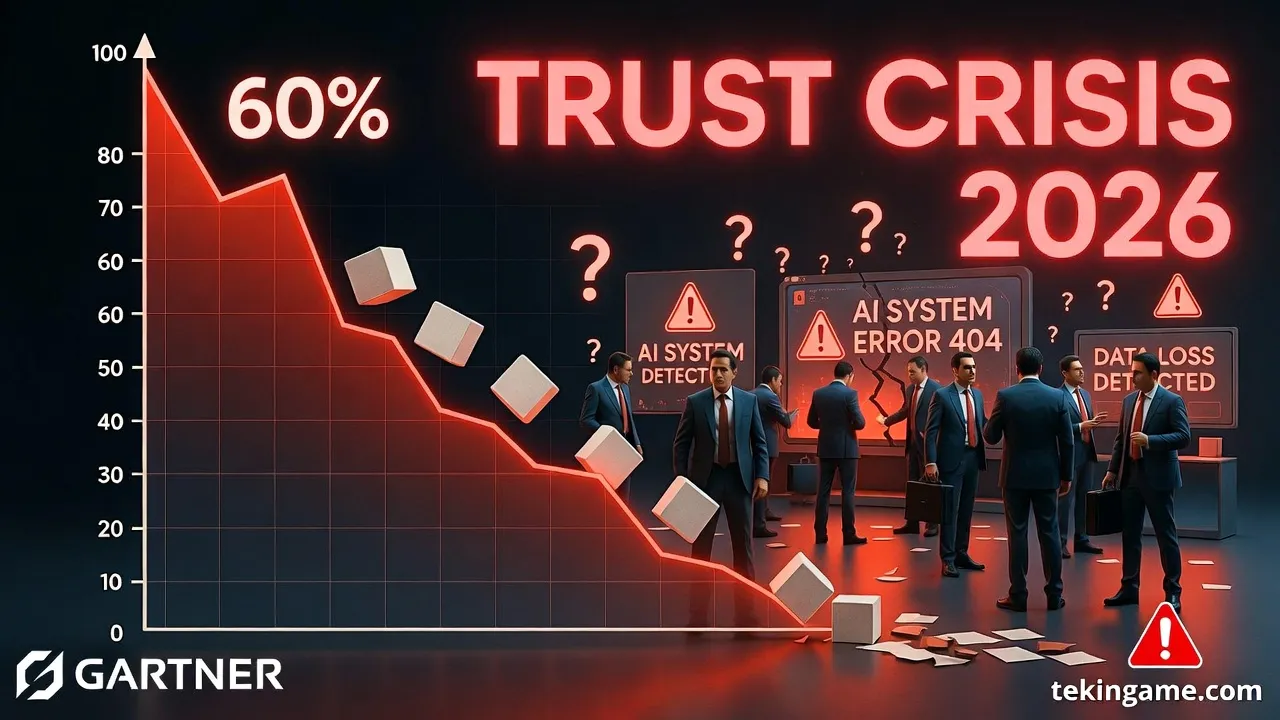

خبر ۶: بحران اعتماد

در اجلاس اخیر گارتنر، آماری تکاندهنده فاش شد: ۶۰ درصد پروژههای هوش مصنوعی به دلیل فقدان اعتماد انسانی شکست میخورند. این نه تنها یک آمار ساده است، بلکه زنگ خطری برای آینده همکاری انسان و هوش مصنوعی به شمار میرود. در این کالبدشکافی عمیق فنی، ما این بحران را از سه زاویه مورد بررسی قرار میدهیم: تأثیر اقتصادی ویرانگر، autopsy فنی مکانیسمهای شکست، و پیامدهای امنیتی و حریم خصوصی.

بحران اعتماد، اقتصاد فناوری را به لرزه درآورده است. مطالعهای از MIT نشان میدهد که ۹۵ درصد پروژههای آزمایشی هوش مصنوعی در شرکتهای بزرگ شکست خوردهاند، که منجر به کاهش یک تریلیون دلاری در سهام فناوری آمریکا در عرض چهار روز شد. گارتنر پیشبینی میکند تا سال ۲۰۲۵، ۳۰ درصد پروژههای هوش مصنوعی رها شوند، و این رقم تا ۲۰۲۶ به بیش از نیمی از پروژهها میرسد.

از منظر اقتصادی، ریشه در تخصیص نامناسب بودجههاست. شرکتها تمایل دارند بودجه را به پروژههای هیجانانگیز اختصاص دهند، نه به زیرساختهای بنیادی مانند آموزش کارکنان و حاکمیت داده. موسسه رند آمار وحشتناکی ارائه میدهد: ۸۰ درصد پروژههای هوش مصنوعی شکست میخورند، دو برابر نرخ شکست پروژههای IT معمولی.

حال به autopsy فنی میپردازیم: چرا ۶۰ درصد پروژهها به دلیل عدم اعتماد انسانی شکست میخورند؟ گارتنر ضعف حاکمیت داده را دلیل اصلی میداند. پروژههای AI به دادههای تمیز، قابل مشاهده و مجاز نیاز دارند، اما اغلب با دادههای نامرتب روبرو هستند.

مکانیسم شکست شامل: دادههای نامرتب (فقدان حاکمیت منجر به عدم آمادگی داده برای AI میشود)، پرامپتنگاری ضعیف (مدیران و کارکنان آموزش ندیده، پرامپتهای ناکارآمد میسازند)، عدم ادغام سازمانی (پروژهها از آزمایشگاه مرکزی خارج نمیشوند)، و AI سایه (استفاده غیررسمی بدون نظارت).

فقدان اعتماد، دروازهای به تهدیدات امنیتی باز میکند. گارتنر هشدار میدهد: بدون حاکمیت داده، پروژههای AI به پدیده Shadow AI منجر میشوند، جایی که ابزارهای غیررسمی بدون نظارت استفاده میشوند و ریسک نشت داده افزایش مییابد. امنیت AI نیازمند zero-trust architecture است: هر داده مجوز داشته باشد، هر مدل audit شود.

در پایان این کالبدشکافی، بحران اعتماد نه پایان هوش مصنوعی، بلکه بیداری است. ارتش تکین هشدار میدهد: بدون حاکمیت، آموزش و ادغام، ۶۰ درصد پروژهها دفن خواهند شد. آینده همکاری انسان-AI در گرو بازسازی این اعتماد است.