1. زلزله در بازار بورس: چرا سهام Nvidia با انتشار DeepSeek سقوط کرد؟

شاید بپرسید انتشار یک مدل زبانی چه ربطی به قیمت سهام سختافزار دارد؟ پاسخ در "بهینگی" است. تا امروز، تصور میشد برای داشتن هوشمندیِ سطح GPT-4، شما نیاز به کلاسترهای عظیم با ده هزار کارت گرافیک H100 دارید. اما DeepSeek ثابت کرد که با سختافزار بسیار کمتر و تکنیکهای نرمافزاری هوشمندتر، میتوان به همان نتیجه رسید.

این خبر برای انویدیا (که سودش از فروش چیپهای گرانقیمت است) بد بود، چون نشان داد حباب تقاضا برای چیپ ممکن است زودتر از انتظار بترکد. دیپسیک نشان داد که "هوش مصنوعی" لزوماً نباید "گران" باشد.

2. راز فنی: کالبدشکافی معماری Mixture-of-Experts (MoE)

بیایید فنی صحبت کنیم. مدلهای سنتی مثل نسخههای اولیه GPT، مدلهای "Dense" (متراکم) بودند. یعنی وقتی شما میپرسیدید "۲+۲ چند میشود؟"، کل شبکه عصبی (تمام میلیاردها پارامتر) فعال میشد تا جواب دهد.

معماری MoE چیست؟

DeepSeek-V4 از معماری Mixture-of-Experts استفاده میکند. تصور کنید مغز این هوش مصنوعی به صدها "متخصص کوچک" تقسیم شده است:

- یک متخصص کدنویسی پایتون 🐍

- یک متخصص شعر گفتن 📝

- یک متخصص ریاضیات ➕

وقتی شما سوال کدنویسی میپرسید، یک "روتر" (Router) هوشمند، سوال شما را فقط به "متخصص پایتون" میفرستد و بقیه متخصصان خاموش میمانند. نتیجه؟ مدل ۶۷ میلیارد پارامتر دارد، اما برای هر توکن (کلمه) فقط حدود ۵ میلیارد پارامتر فعال میشود. این یعنی سرعتی وحشتناک بالا و هزینه پردازشی بسیار پایین.

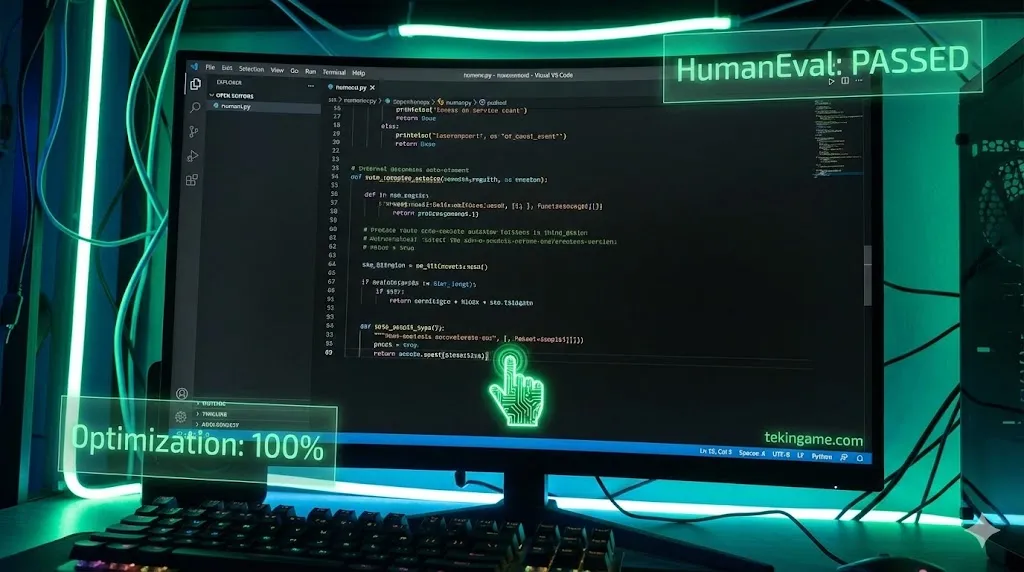

3. بنچمارکها دروغ نمیگویند: پیروزی در کدنویسی

برای مخاطبان برنامهنویس تکینگیم، این بخش حیاتی است. دیپسیک در تست معروف HumanEval (که توانایی نوشتن تابعهای پایتون را میسنجد) غوغا کرده است.

این مدل نه تنها کد صحیح تولید میکند، بلکه در "استدلال منطقی" برای دیباگ کردن کدهای پیچیده، عملکردی خیرهکننده دارد. بسیاری از دولوپرها گزارش دادهاند که DeepSeek در درک کانتکست پروژههای بزرگ، بهتر از کلاد (Claude) عمل میکند.

4. اقتصاد جنگ: آموزش ۶ میلیون دلاری در برابر ۱۰۰ میلیون دلاری

اینجا جایی است که آمریکا ترسید. طبق گزارشهای فنی (Whitepaper) منتشر شده، هزینه آموزش (Training Cost) مدل DeepSeek حدود ۵.۶ میلیون دلار برآورد شده است. برای مقایسه، سام آلتمن تایید کرده بود که آموزش GPT-4 بیش از ۱۰۰ میلیون دلار هزینه داشته است.

چینیها با استفاده از بهینهسازیهای سطح پایین (Low-level Optimization) و مدیریت حافظه هوشمند، توانستند با ۱/۲۰ بودجه رقبا، محصولی مشابه تولید کنند. این یعنی "انحصار" شرکتهای تریلیون دلاری شکسته شده است. حالا هر شرکت متوسطی میتواند مدل اختصاصی خودش را داشته باشد.

5. امنیت و حریم خصوصی: آیا میتوانیم به AI چینی اعتماد کنیم؟

این فیل در اتاق است! (The Elephant in the room). آیا باید کدهای شرکتتان را به DeepSeek بدهید؟

- نسخه Chat (آنلاین): سرورهای این چتبات در چین هستند. طبق قوانین چین، دولت دسترسی کامل به دادهها دارد. پس اکیداً توصیه میکنیم اطلاعات حساس، پسوردها یا کدهای محرمانه شرکت را در نسخه وب وارد نکنید.

- نسخه Open Source (لوکال): خبر خوب این است که DeepSeek مدلهایش را متنباز کرده است. شما میتوانید فایلهای مدل (Weights) را دانلود کنید و روی سرور شخصی خودتان یا با ابزارهایی مثل Ollama روی لپتاپ اجرا کنید. در این حالت، هیچ دیتایی از سیستم شما خارج نمیشود و کاملاً امن است.

6. راهنمای استفاده: چگونه DeepSeek را جایگزین Copilot کنیم؟

اگر میخواهید از قدرت این مدل برای کدنویسی استفاده کنید، بهترین راه استفاده از پلاگینهایی مثل Continue.dev در VS Code است.

- اکستنشن Continue را در VS Code نصب کنید.

- از لیست مدلها، DeepSeek-Coder-V2 را انتخاب کنید.

- نیاز به API Key دارید که هزینه آن تقریباً ۱/۵۰ (یک پنجاهم) هزینه API شرکت OpenAI است.

با این کار، شما یک دستیار هوشمند فوق ارزان و قدرتمند دارید که مستقیماً در ادیتور شما زندگی میکند.

🏁 جمعبندی بازرس

دیپسیک ثابت کرد که "نبوغ" جایگزین "پول" میشود. این مدل یک زنگ بیدارباش برای دنیای تکنولوژی بود.

برای ما کاربران ایرانی، DeepSeek دو مزیت بزرگ دارد: اول اینکه ارزان و در دسترس است (و فعلاً سختگیریهای تحریمی OpenAI را ندارد) و دوم اینکه نسخه آفلاین آن روی سیستمهای قوی قابل اجراست.

اگر برنامهنویس هستید، حتی یک لحظه هم در تست کردن مدل DeepSeek-Coder شک نکنید.

💬 آیا حاضرید به خاطر هوش بالا، ریسک استفاده از مدل چینی را بپذیرید؟ یا هنوز به GPT-4 وفادارید؟