في النصف الأول من عام ٢٠٢٦، يشهد قطاع مراكز البيانات انقراضاً صامتاً: الموت المنهجي لوحدة المعالجة المركزية (CPU) باعتبارها القلب النابض لخوادم المؤسسات. يحلل هذا التقرير الاستراتيجي (أكثر من ٢٥٠٠ كلمة) زوال بنية x86 مقابل السيادة المطلقة لوحدات معالجة الرسومات (GPUs) ووحدات المعالجة العصبية (NPUs). نقوم بتشريح بنية Nvidia Grace-Blackwell، والحدود الديناميكية الحرارية القاتلة لمراكز البيانات المبردة بالهواء، واقتصاديات الاستنتاج بالذكاء الاصطناعي في بيئة الشركات. تعتبر هذه الوثيقة خارطة طريق حاسمة لرؤساء التكنولوجيا (CTOs) لمنع الإنفاق الرأسمال

سقوط إمبراطورية الـ CPU: لماذا سيطرت وحدات GPU و NPU على مراكز بيانات الشركات ٢٠٢٦

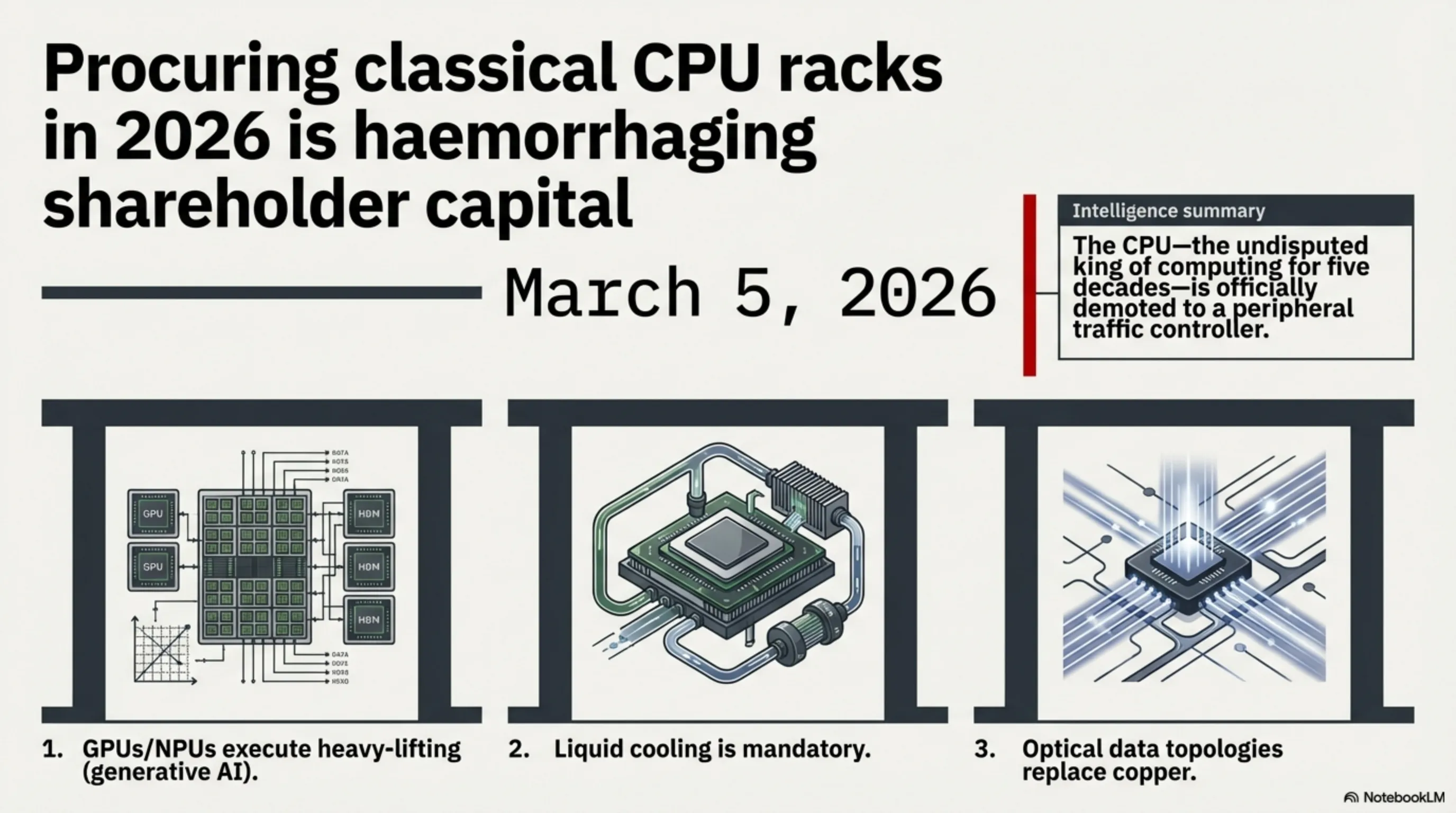

مرحباً بكم في إيجاز Tekin Analytics. اليوم هو الخامس من مارس ٢٠٢٦، وإذا كنت تقوم حالياً بتصميم مركز بيانات جديد يعتمد على "رفوف مليئة بوحدات المعالجة المركزية (CPUs)" الكلاسيكية، فأنت تُدمر فعلياً رأسمال مساهميك. يمثل عام ٢٠٢٦ نقطة التحول الدقيقة التي تم فيها خفض رتبة وحدة المعالجة المركزية - الملك المتوج للحوسبة بلا منازع لخمسة عقود - رسمياً إلى وحدة تحكم طرفية لتوجيه البيانات للوحوش الحقيقية: وحدات GPU و NPU. في هذا التقرير الدقيق، نقوم بتشريح تشريح هذا التحول النموذجي.

الطبقة الاستراتيجية ١: نهاية قانون مور وانخفاض x86

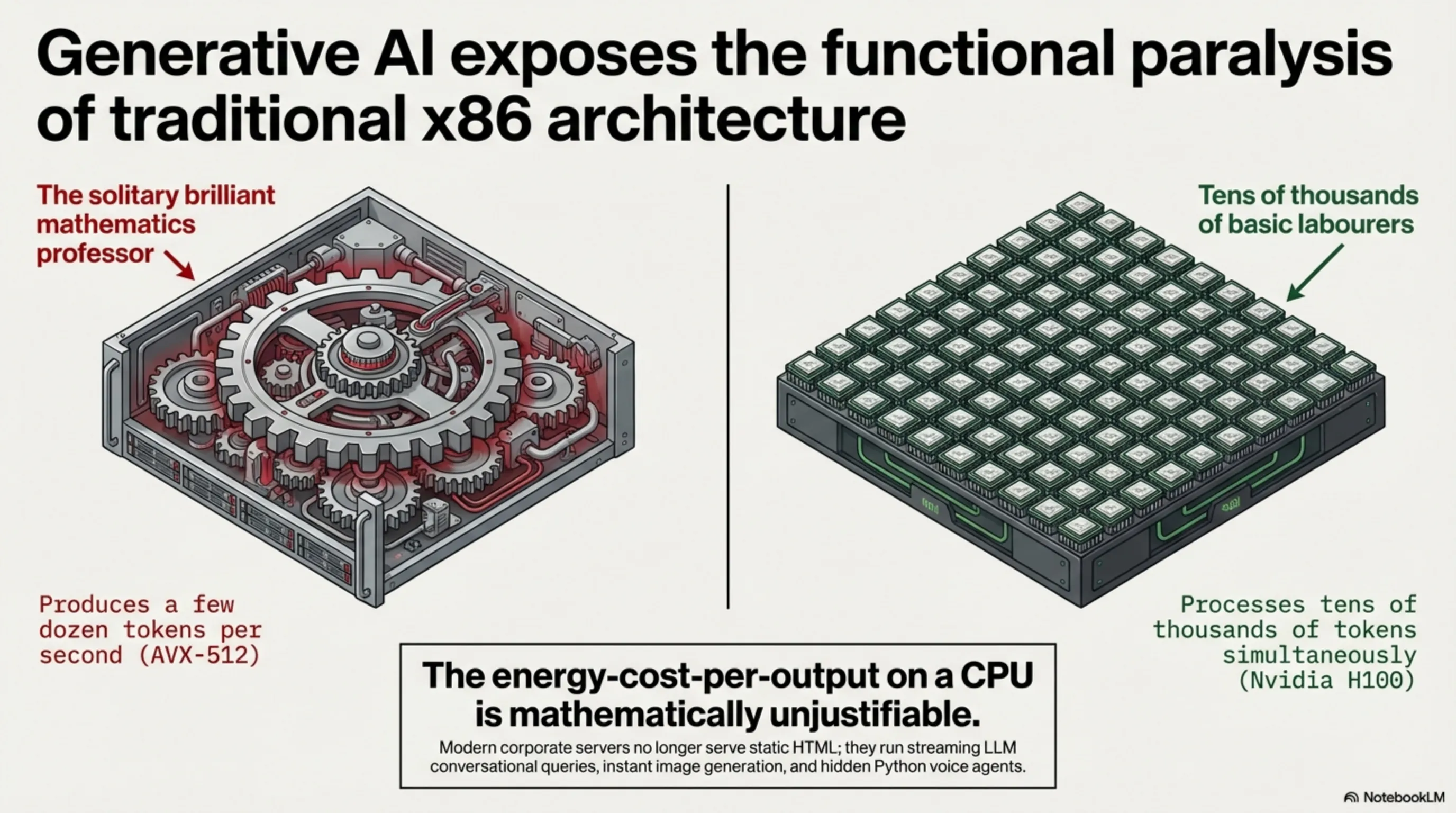

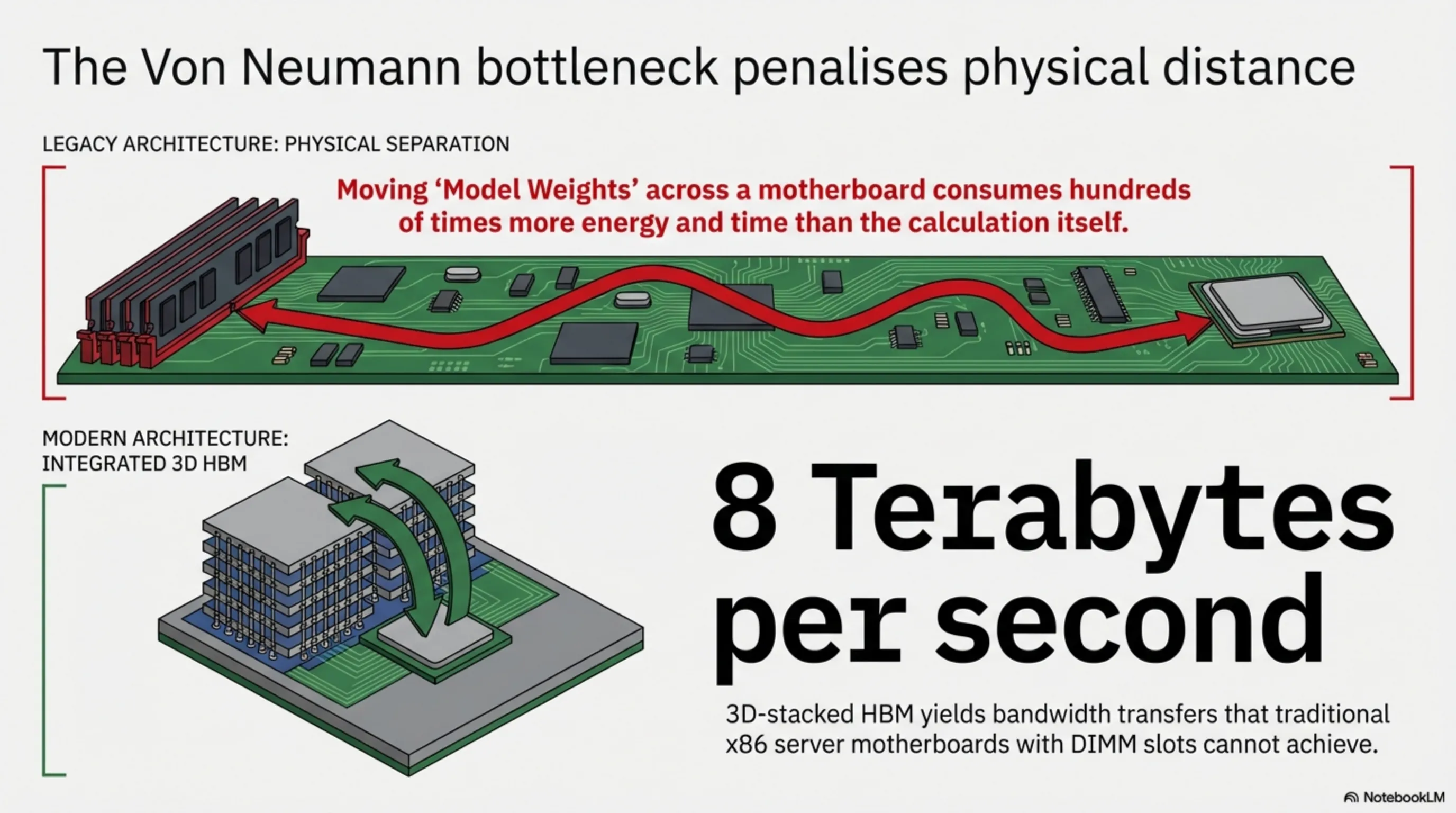

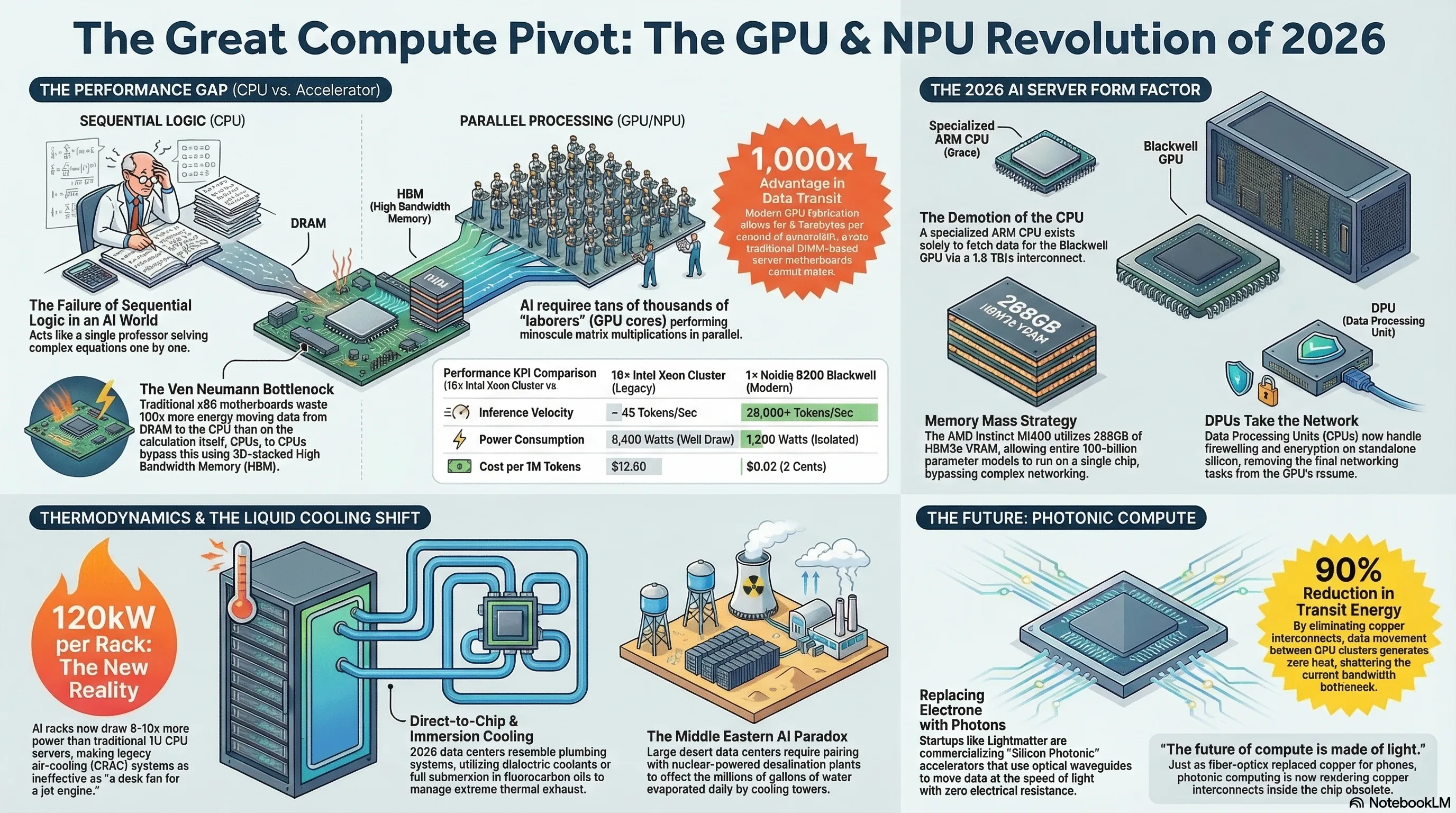

تم تصميم وحدات المعالجة المركزية (CPUs) بشكل معقد حول مجموعات تعليمات رياضية شديدة التعقيد والتنوع. وهي تعمل كأستاذ رياضيات لامع قادر على حل المعادلات التفاضلية العميقة بالتسلسل. ومع ذلك، فإن الذكاء الاصطناعي التوليدي لا يحتاج إلى "أستاذ رياضيات واحد". بل يحتاج إلى عشرات الآلاف من العمال الأساسيين الذين يؤدون مهام ضرب المصفوفات الدقيقة بالتوازي. هذا هو بالضبط المكان الذي تنهار فيه وحدات المعالجة المركزية.

١.١ لماذا وحدات CPU مشلولة וظيفياً في الذكاء الاصطناعي؟

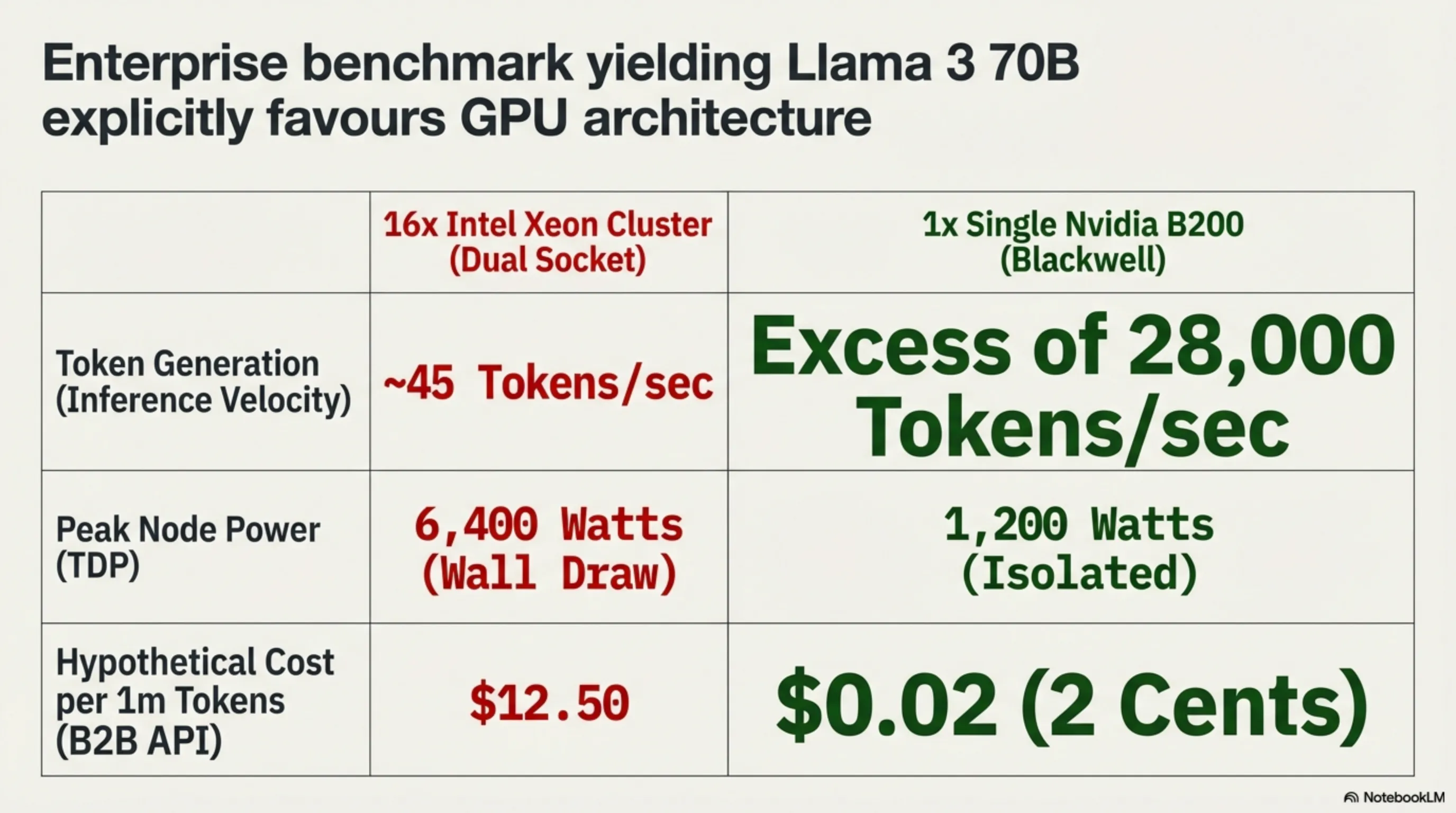

في عام ٢٠٢٦، لم تعد خوادم الشركات "تُقدم" صفحات ويب بتنسيق HTML ثابت ببساطة. كل مستخدم نهائي يتفاعل عبر تدفقات الاستعلام الحوارية مع نموذج لغة كبير (LLM)، طالباً توليد صور فورية، أو تنفيذ نصوص Python عبر وكلاء (Agents) مخفيين. يمكن لمعالج خادم رئيسي مثل Intel Xeon Platinum أن يخرج بضع عشرات من الرموز (Tokens) في الثانية بالكاد. في المقابل، تقوم بطاقة Nvidia H100 أو مثيلاتها بمعالجة عشرات الآلاف من الرموز في توقيت موازٍ. الانحدار مدمر لا رجعة فيه.

📊 المعيار الاستراتيجي: خادم CPU تقليدي ضد مسرع Blackwell

| المقياس الهندسي | مجموعة Intel Xeon (مقبس مزدوج) | بطاقة Nvidia B200 مفردة |

|---|---|---|

| توليد الرموز في الثانية (سرعة الاستنتاج) | حوالي ٤٥ رمزاً | يتجاوز ٢٨,٠٠٠ رمزاً |

| نفقات الواجهة البرمجية (لكل مليون رمز) | $١٢.٥ دولار | سِنتان فقط ($٠.٠٢) |

الطبقة الاستراتيجية ٢: التمزيق التقني لخوادم ٢٠٢٦

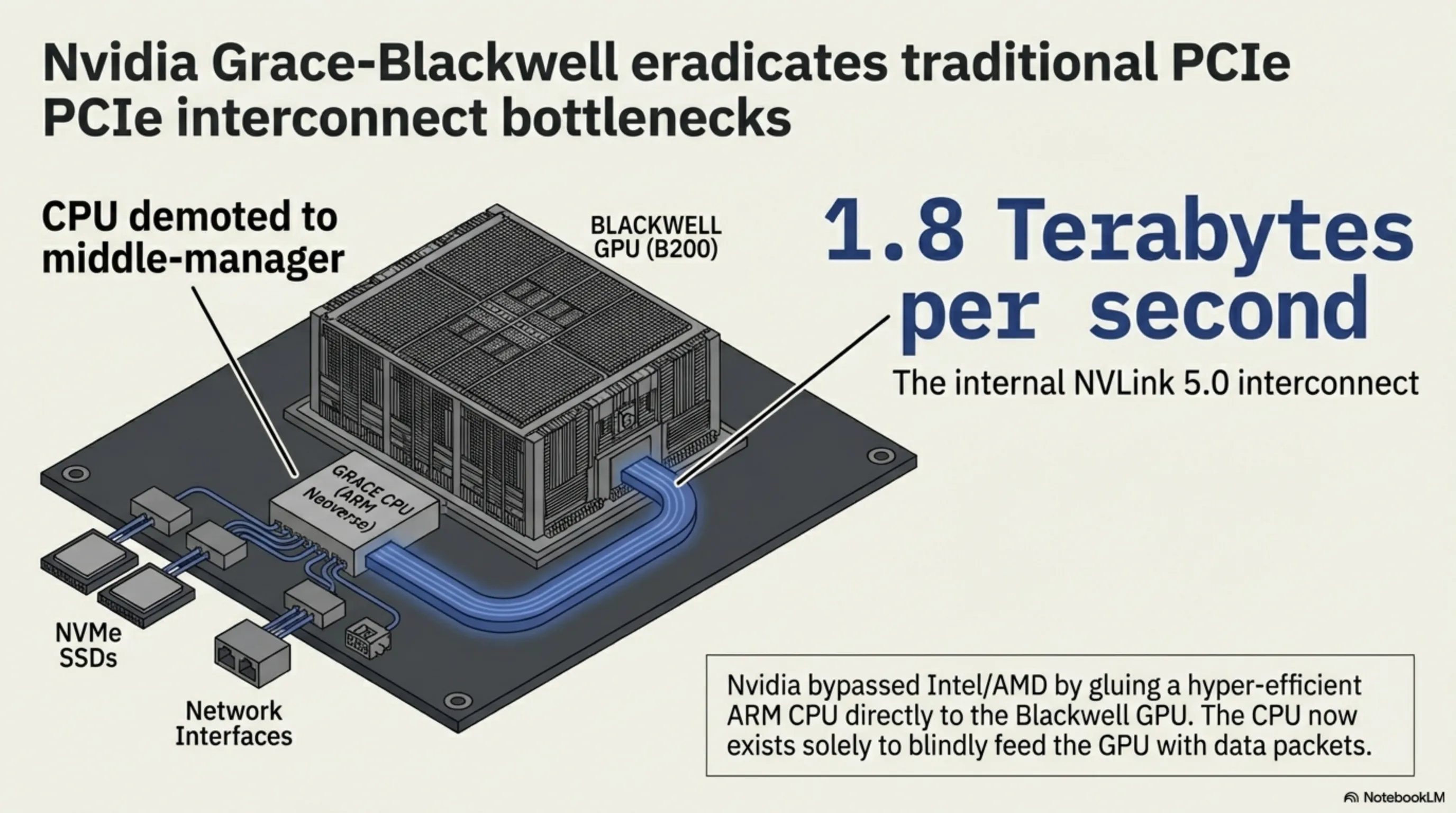

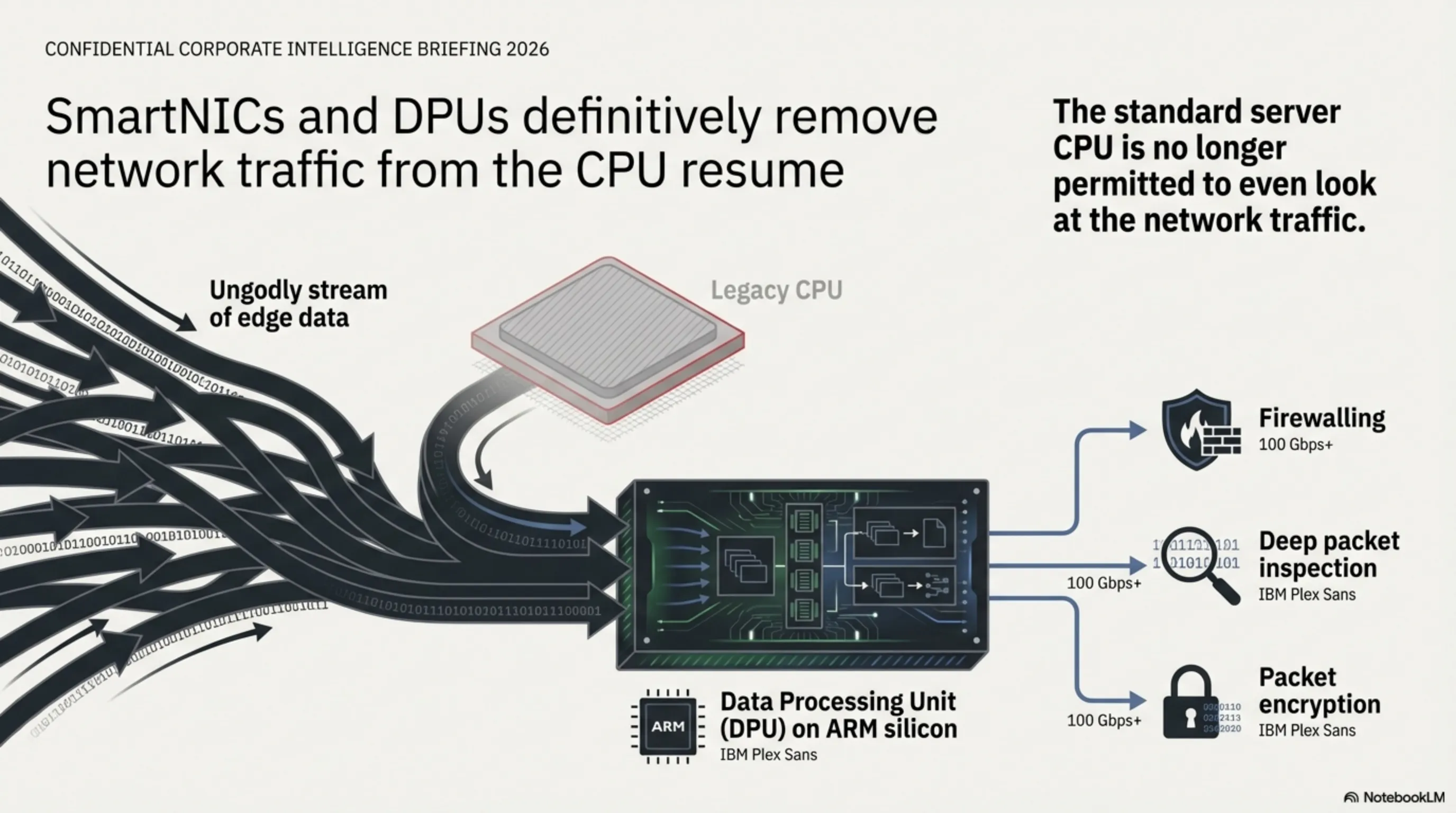

أطلقت Nvidia رصاصة الإعدام على النظام البيئي x86 من خلال إطلاق شرائح Grace-Blackwell الفائقة. بدلاً من إدراج بطاقاتهم الرسومية في نظام Intel / AMD ، قامت شركة التنين الأخضر بصق معالج دقيق (CPU) ذو كفاءة عالية ومخصص جداً (يعتمد على بنية ARM، يسمى Grace) مباشرة إلى جانب معالج رسومي ضخم (Blackwell). داخل هذا النظام البيئي، لا يعد للـ CPU أي وظيفة فعلية باستثناء توجيه بيانات الشبكة وتعبئة القرص الصلب وتمريرها فوراً للـ GPU.

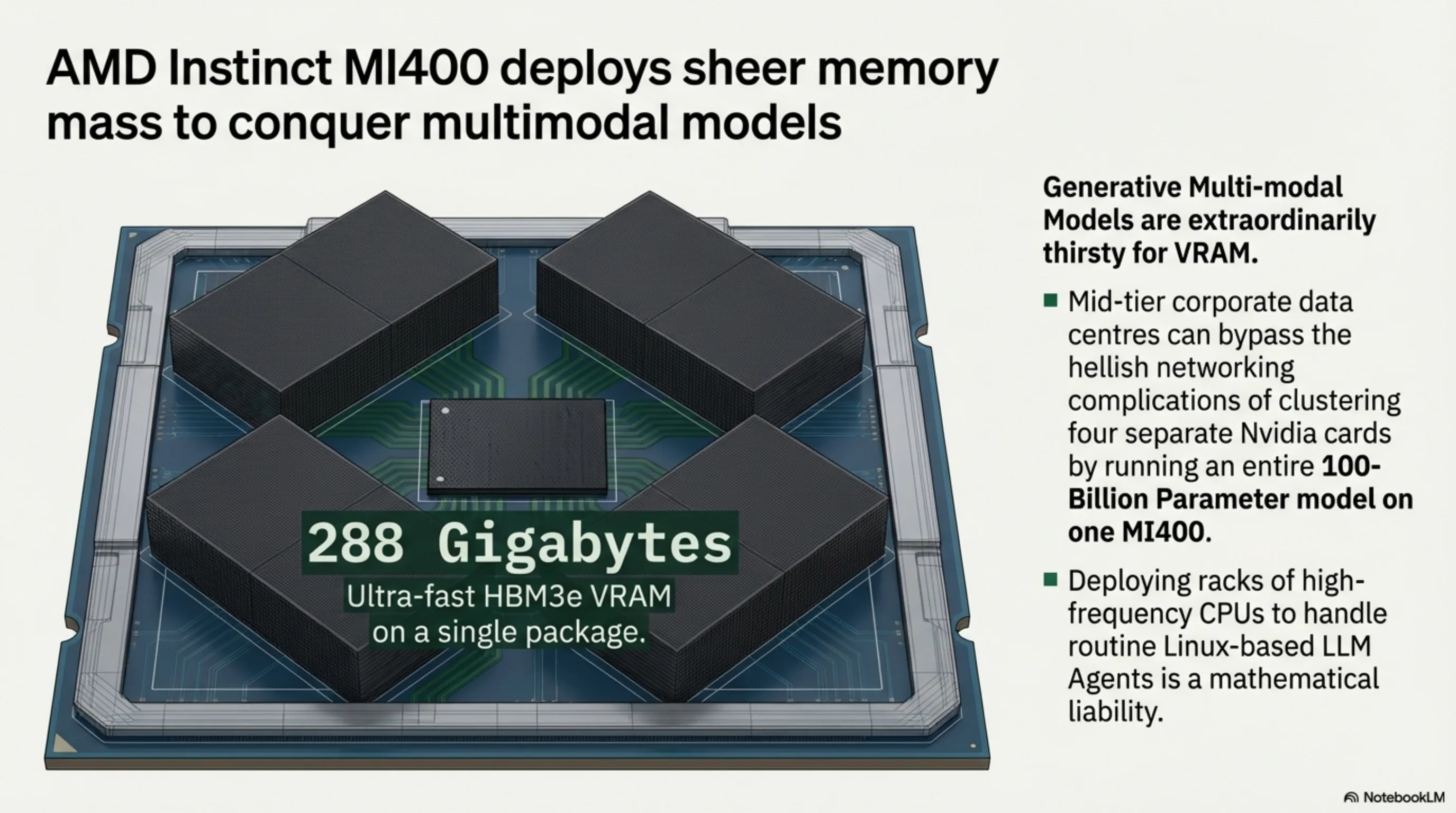

إشارة معمارية: عندما تكون ٨٥٪ من مهام معالجة الشركات اليومية تنفذ بواسطة وكلاء ذكاء اصطناعي (AI Agents)، فإن تعبئة حوامل الخوادم بمعالجات CPU عالية التردد يعد عائقاً حسابياً هائلاً.

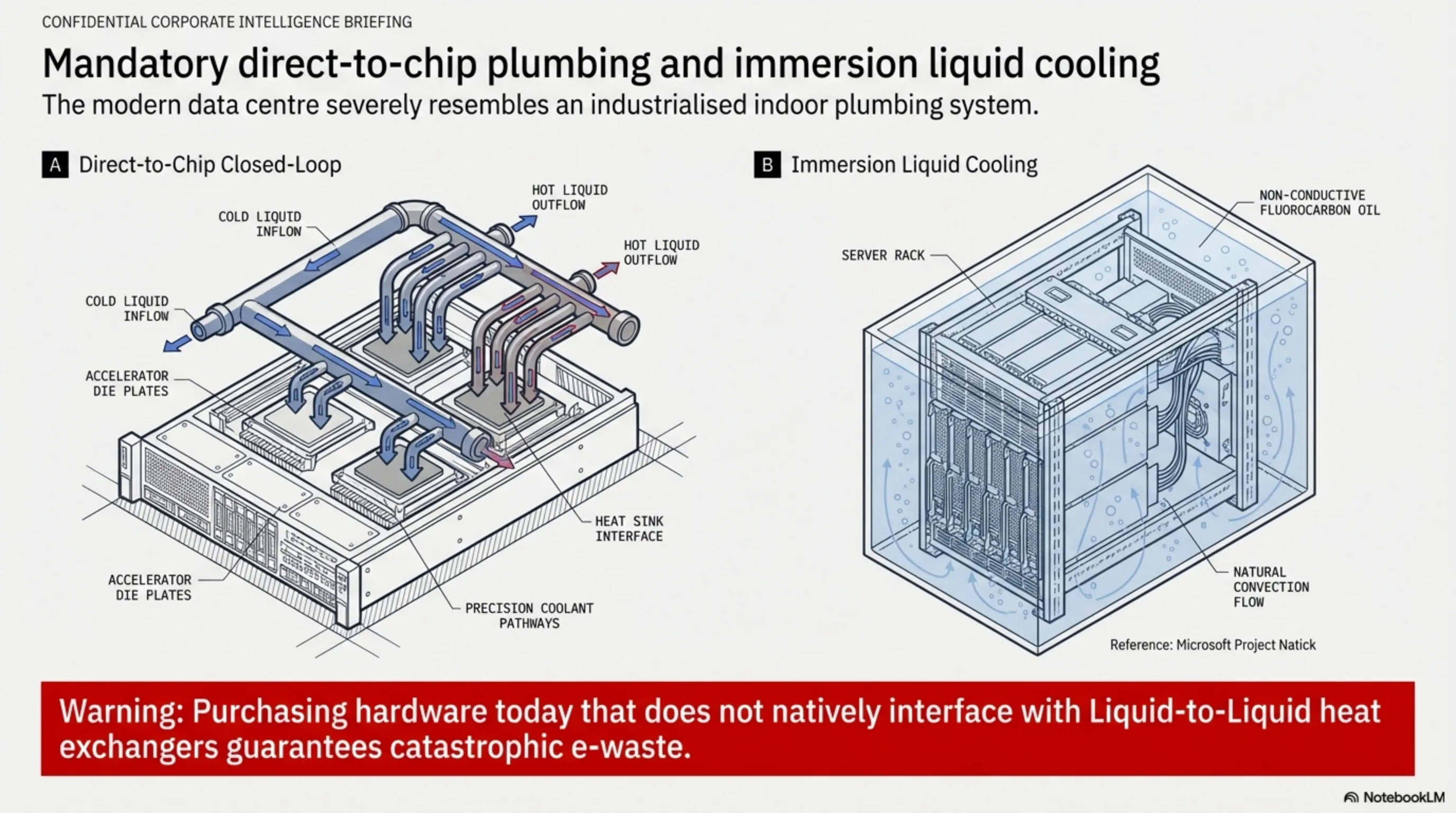

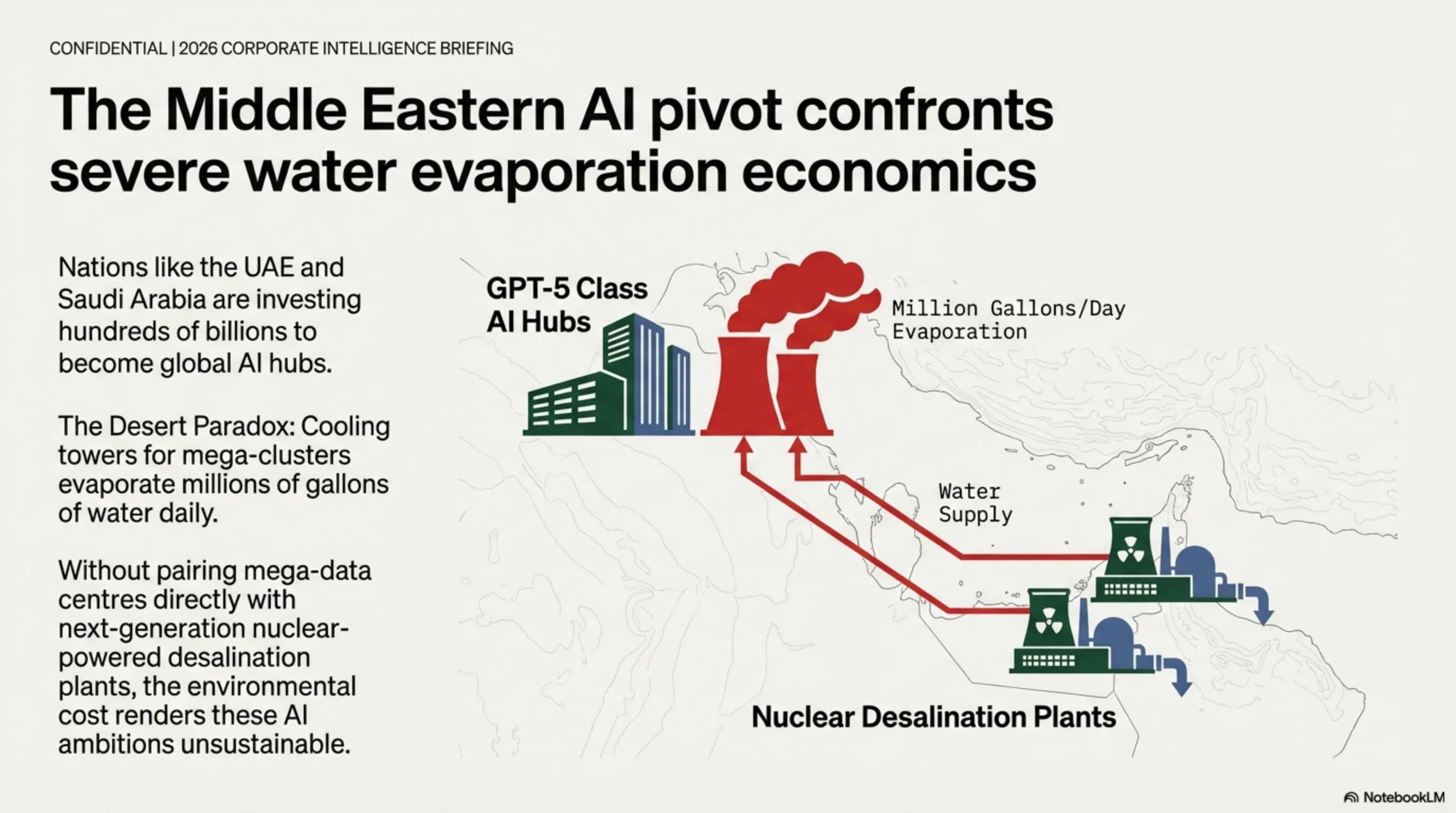

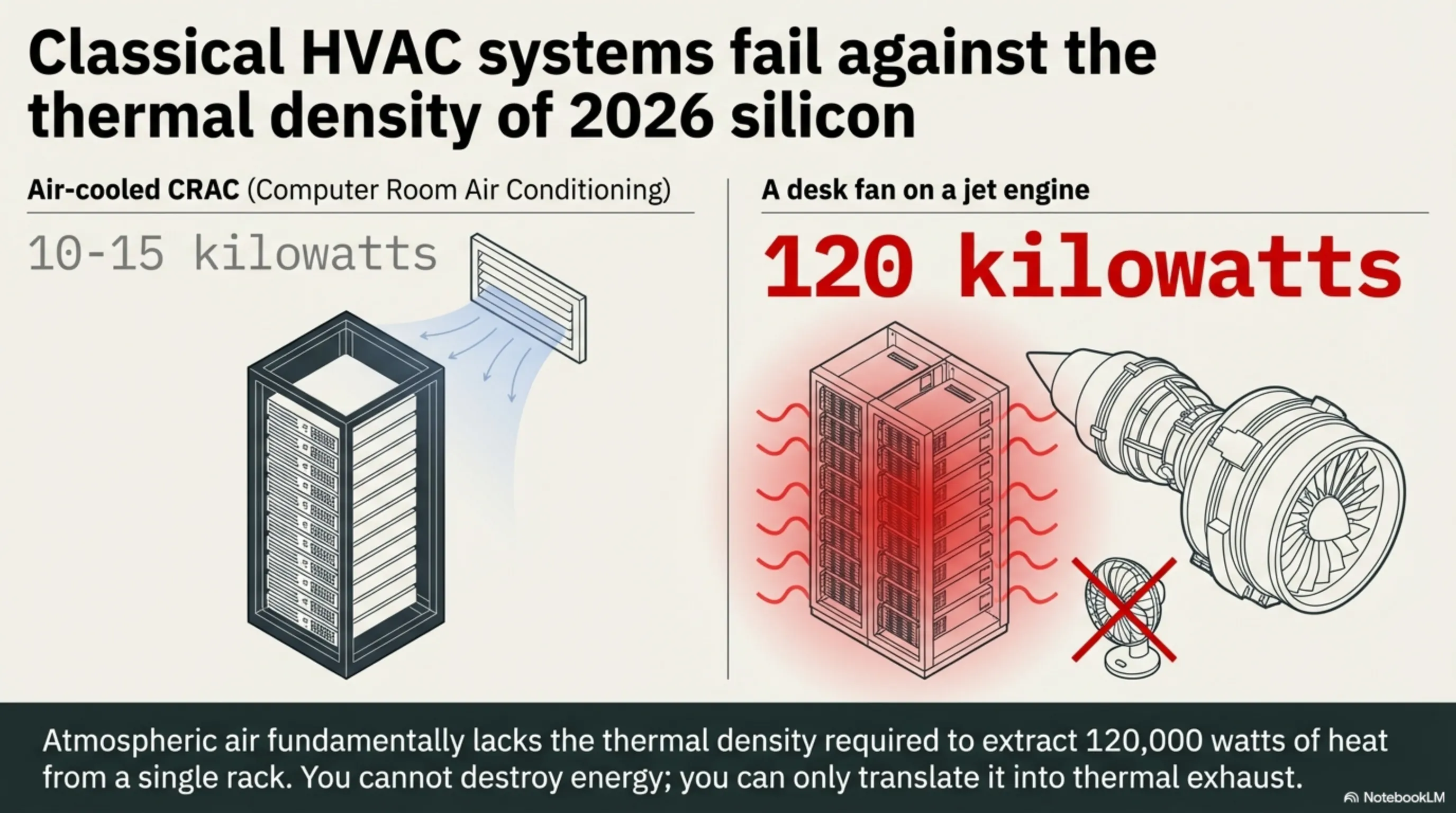

الطبقة الاستراتيجية ٣: الديناميكا الحرارية وبحيرات الخليج

قوانين الفيزياء الكلاسيكية تقف الآن كأكبر عائق. الرف الخادم الممتلئ بمسرعات بلاكويل يسحب حوالي 120 كيلواط. وهذا ضاعف الطلب على التبريد المباشر من خلال غمر المراكز بأنابيب ضخ السوائل العازلة. كما زاد ذلك من معدلات تبخر المياه في ابراج التبريد (Cooling Towers)، وهو تحد حقيقي يقف في وجه الاستثمارات الخليجية بمنطقة الشرق الأوسط ما لم تقترن عمليات بناء مراكز بيانات الذكاء الاصطناعي بمحطات ضخمة لتحلية المياه وتوليد الطاقة الشمسية.

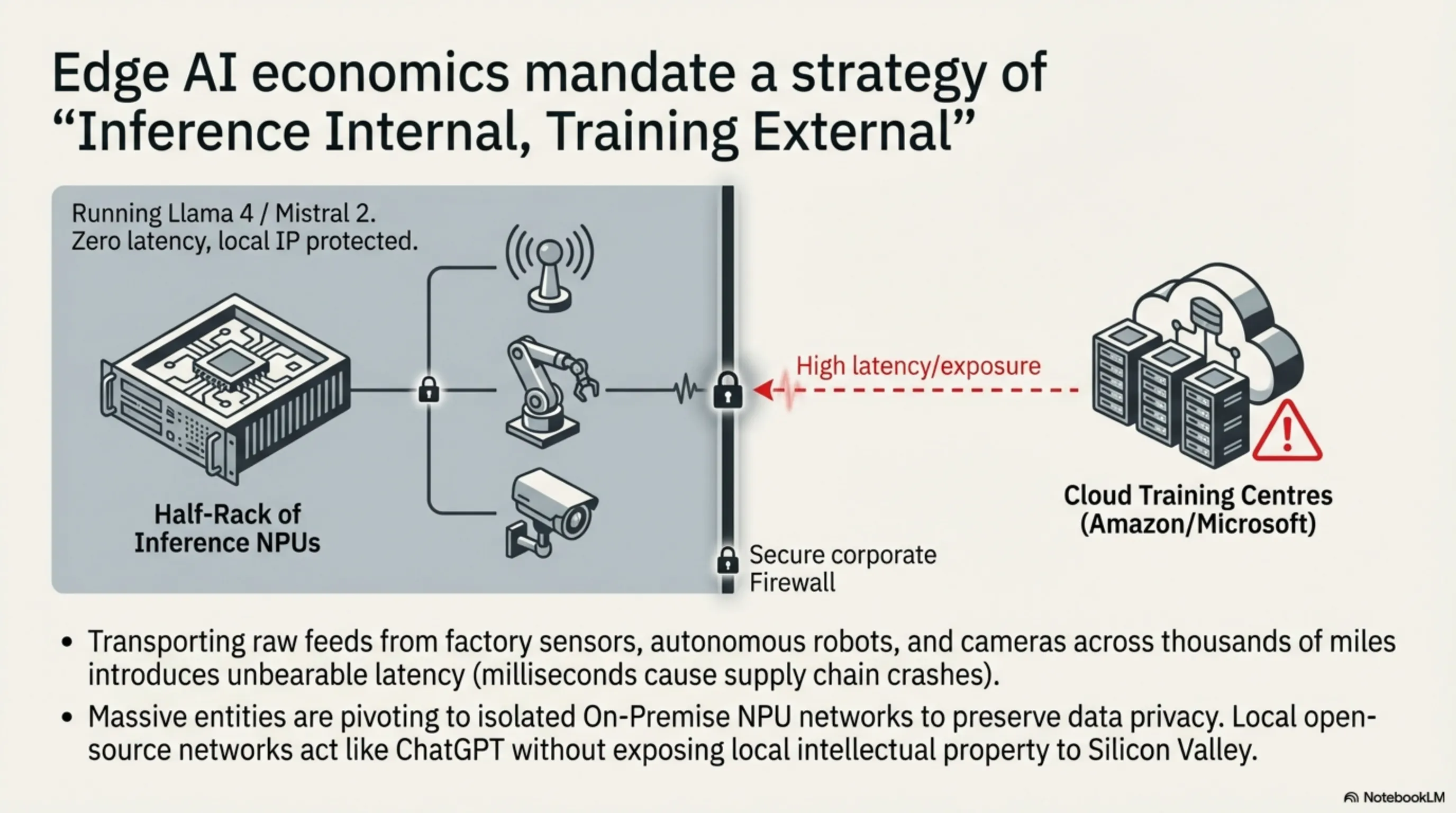

الطبقة الاستراتيجية ٤: الذكاء الاصطناعي للشركات (On-Prem Edge)

يعد الاتجاه الغالب لعام 2026 هو الاعتماد على وحدات المعالجة العصبية الضخمة محاربة لتسريب البيانات وحماية الملكية الفكرية، فبدلاً من الاستعانة بـ ChatGPT من مراكز سحابة خارجية تقوم المؤسسات الكبرى بتزويد خوادمها المعزولة واللامركزية بأطقم من سيرفرات معالجة اللغات المفتوحة المصدر (כגון Llama وMistral).

الطبقة الاستراتيجية ٥: مستقبل مراكز البيانات في الشرق الأوسط وتحديات اللوجستيات السحابية

لقد أدى الانتقال إلى حوسبة الذكاء الاصطناعي فائقة الكثافة إلى تغيير جذري في سلاسل التوريد العالمية وتخطيط البنية التحتية السيادية. لم تعد البصمة المادية لمركز البيانات تقاس بالمتر المربع، بل بإمكانية الوصول إلى المياه الباردة وخطوط أنابيب الكهرباء الهائلة.

٥.١ التحول الإقليمي واقتصاديات استهلاك المياه

تستثمر دول الخليج العربي مئات المليارات بقوة لتصبح مراكز عالمية للذكاء الاصطناعي. ومع ذلك، فإن تشغيل مجموعة ضخمة بمستوى GPT-5 في نظام بيئي صحراوي يخلق مفارقة: تتبخر أبراج التبريد ملايين الغالونات من المياه العذبة يومياً. وبدون ربط مراكز البيانات العملاقة هذه مباشرة بمحطات تحلية المياه التي تعمل بالطاقة النووية أو الشمسية من الجيل القادم، فإن التكلفة البيئية تجعل طموحات الذكاء الاصطناعي هذه غير مستدامة.

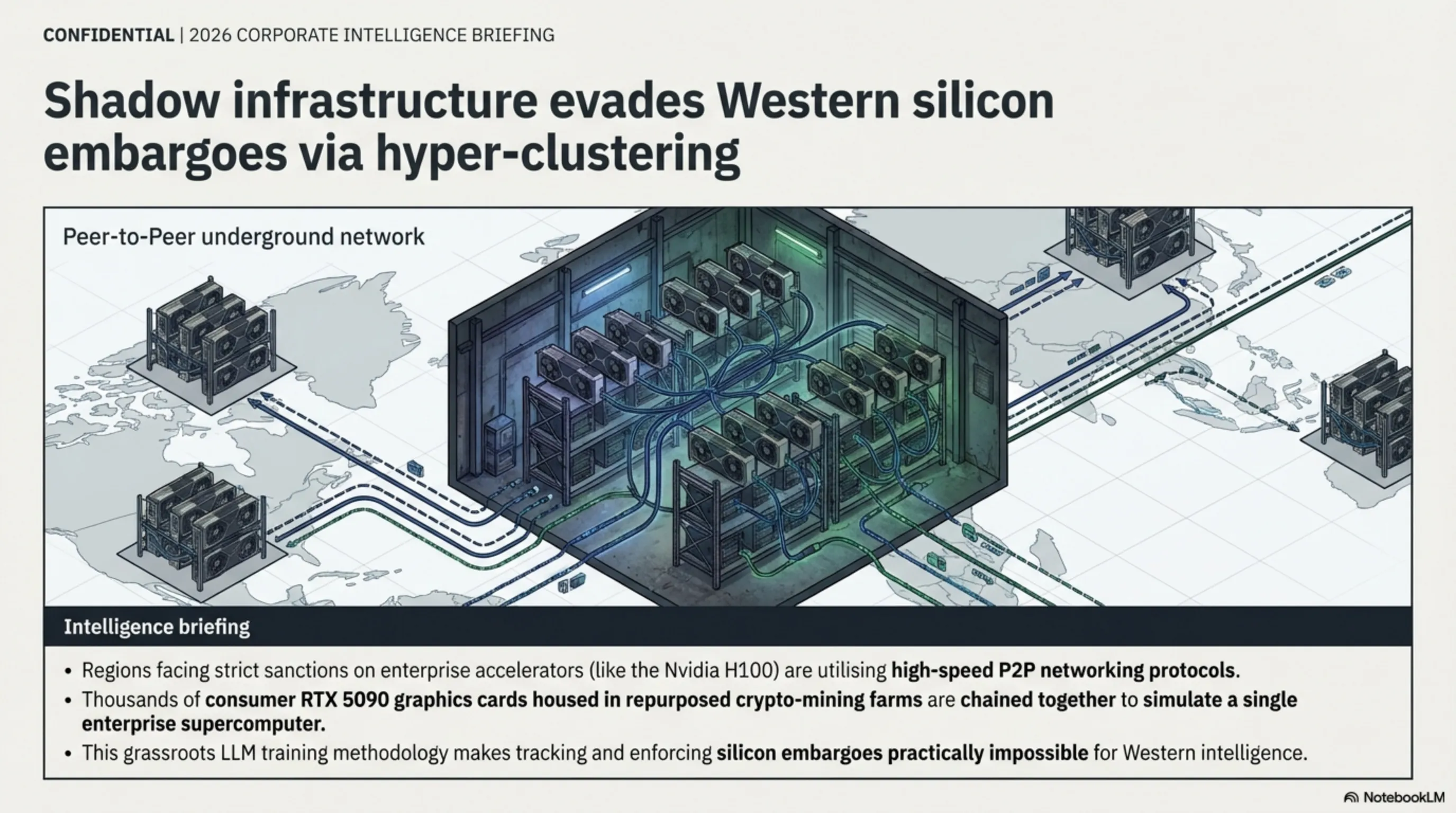

٥.٢ التهرب من الحظر السيليكوني عبر التجميع اللامركزي (Decentralized Clustering)

بالنسبة للمناطق التي تواجه عقوبات غربية صارمة على مسرعات الذكاء الاصطناعي للمؤسسات (مثل حظر تصدير شريحة Nvidia H100)، تحول المهندسون في السوق السوداء إلى "التجميع الفائق" (Hyper-Clustering) لوحدات معالجة الرسومات المخصصة للألعاب (Gaming GPUs). من خلال استخدام بروتوكولات شبكات نظير إلى نظير (Peer-to-Peer) عالية السرعة، يتم ربط آلاف بطاقات الرسوميات مثل RTX 5090—الموجودة في مزارع تعدين العملات المشفرة السابقة—للعمل كحواسيب عملاقة لامركزية. هذه المنهجية لتدريب النماذج اللغوية (LLMs) تجعل تتبع وفرض الحظر السيليكوني أمراً شبه مستحيل على أجهزة المخابرات الغربية.

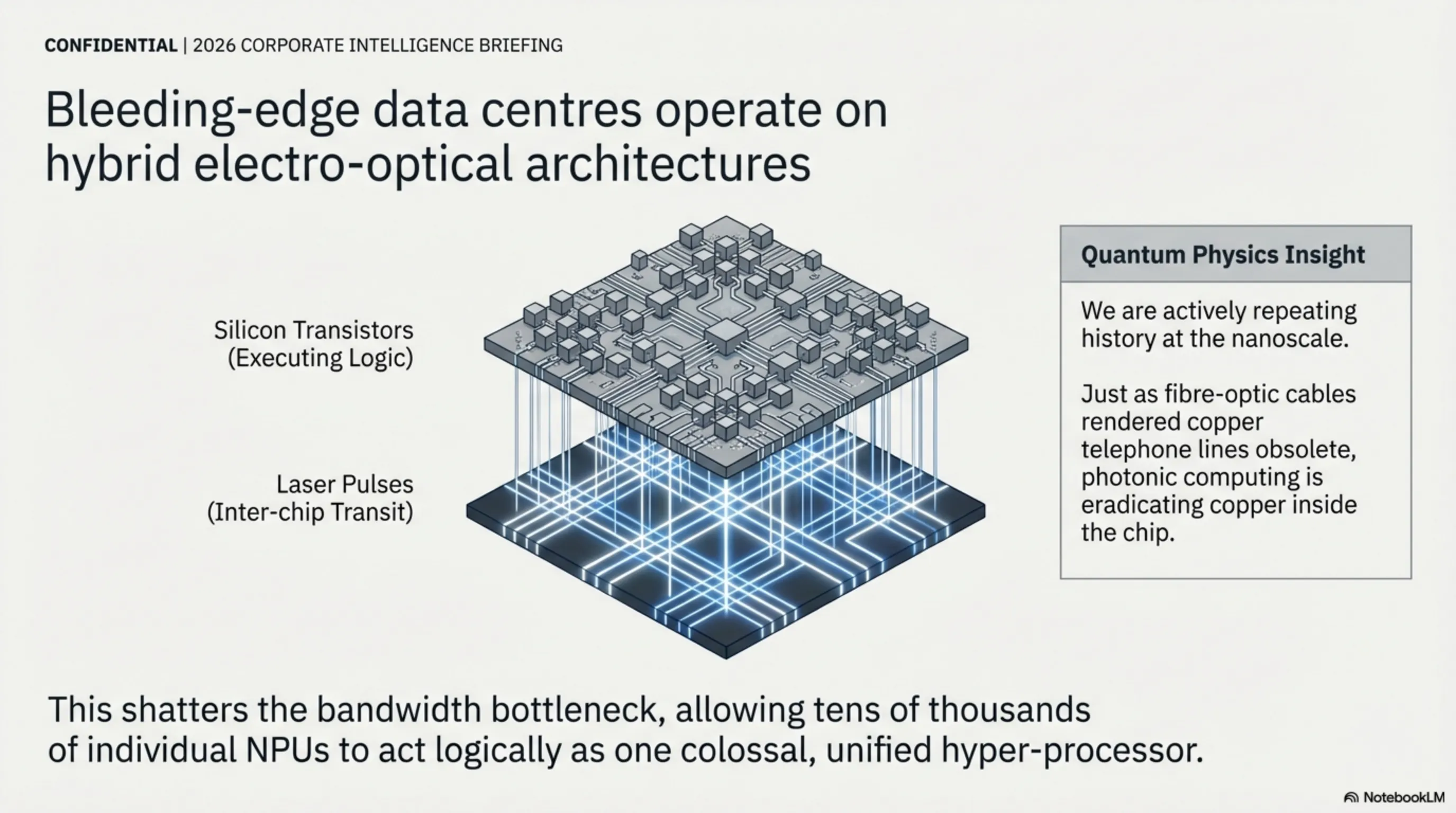

الطبقة الاستراتيجية ٦: البدائل السيليكونية — صعود الحوسبة الفوتونية (الضوئية)

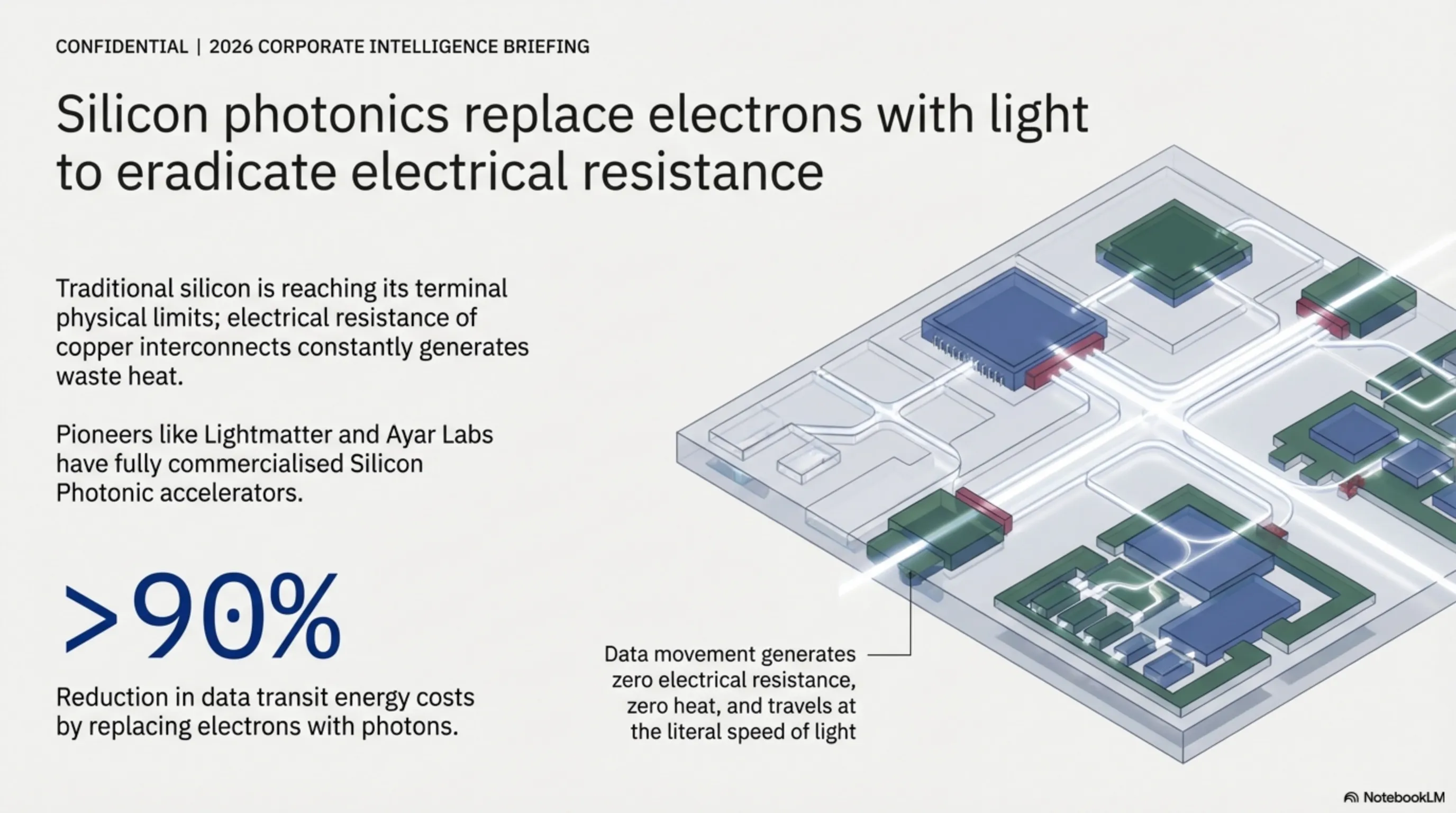

حتى مع التبريد السائل بالغمر وهندسة الذاكرة المكدسة ثلاثية الأبعاد، يصل السيليكون التقليدي إلى حدوده المادية النهائية. تولد المقاومة الكهربائية للأسلاك النحاسية داخل الشريحة حرارة مهدرة باستمرار. الإجابة الحاسمة لهذه الصناعة هي استبدال الإلكترونات بالفوتونات (جزيئات الضوء).

٦.١ الحوسبة الضوئية: القضاء على المقاومة الكهربائية

قامت شركات ناشئة رائدة مثل Lightmatter و Ayar Labs بتسويق مسرعات "السيليكون الفوتوني" (Silicon Photonics) بالكامل في عام ٢٠٢٦. من خلال استخدام الأدلة الموجية البصرية لنقل البيانات داخل قالب المعالج، فإن حركة البيانات تولد مقاومة كهربائية صفرية، وبالتالي حرارة صفرية. يتيح ذلك للبيانات السفر بسرعة الضوء الحرفية بين مجموعات وحدات معالجة الرسومات المترابطة، مما يقلل من تكلفة الطاقة لنقل البيانات بنسبة تزيد عن ٩٠٪.

٦.٢ المعمارية الهجينة الكهرو-بصرية

يعمل مركز البيانات الأحدث والأكثر تطوراً الآن على طوبولوجيا هجينة. في حين لا تزال الحسابات المنطقية الخام تنفذ بواسطة ترانزستورات السيليكون، يتم تسهيل جميع الاتصالات داخل الشريحة وفيما بينها عبر نبضات ليزر ضوئية. يحطم هذا التحول النموذجي اختناق النطاق الترددي للبيانات تماماً، مما يسمح لعشرات الآلاف من وحدات المعالجة العصبية (NPUs) الفردية بالعمل منطقياً كمعالج عملاق واحد موحد.

رؤية فيزياء الكم: نحن نكرر التاريخ بنشاط على مستوى النانومتر. تماماً كما جعلت كابلات الألياف الضوئية خطوط الهاتف النحاسية عتيقة الطراز في الاتصالات العالمية، تعمل الحوسبة الفوتونية حالياً على القضاء على الخطوط النحاسية داخل الشريحة نفسها. مستقبل الحوسبة، بالمعنى الحرفي للكلمة، مصنوع من الضوء.

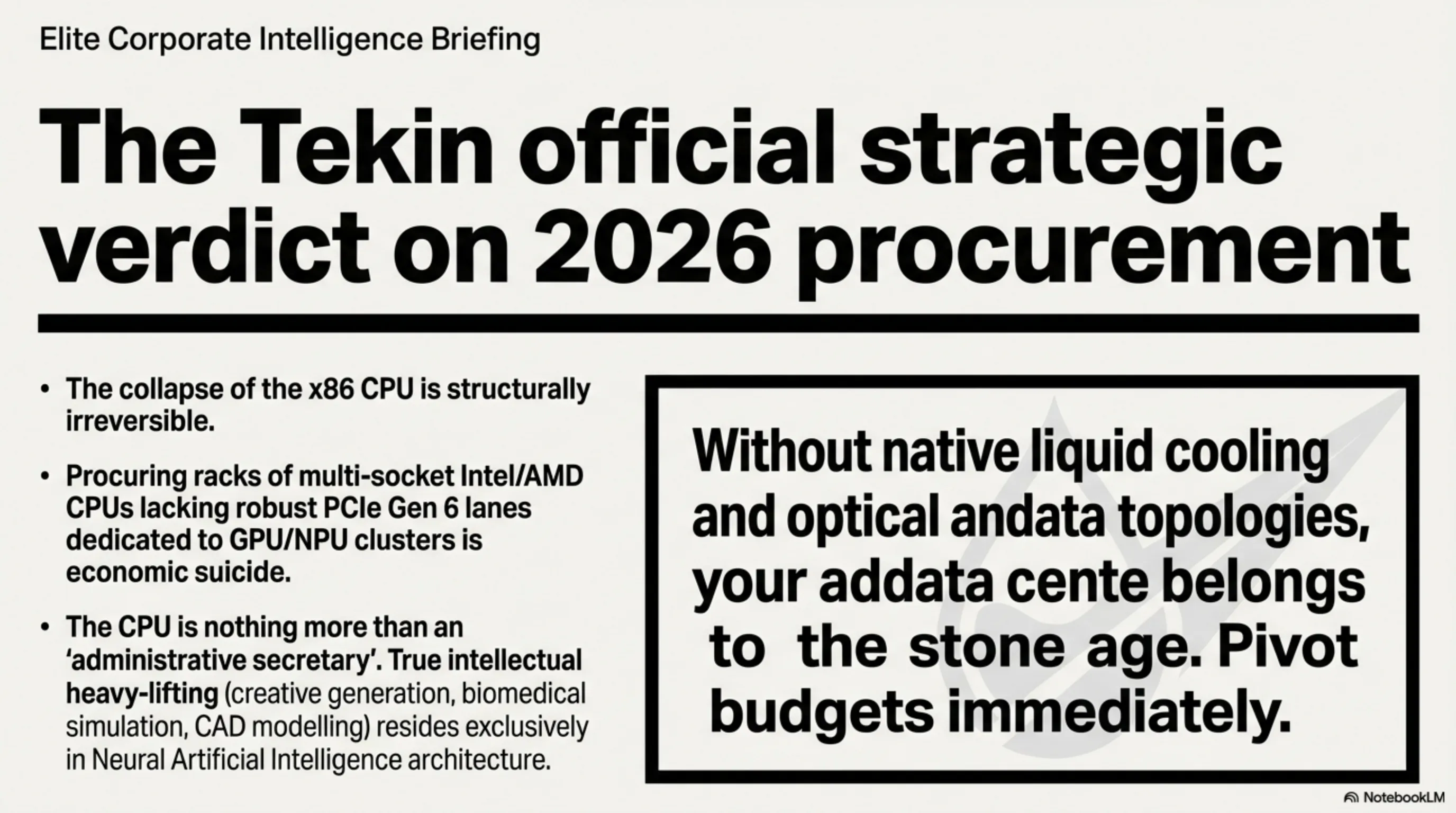

⚖️ الحكم الهندسي الرسمي لـ Tekin

إن انهيار معالجة الـ x86 بالكامل هي نتيجة حتمية لما يشهده الذكاء الإنتاجي وتطور مكاتب البيانات للشركات العابرة للقارات. إن ميزانيات التقنية اليوم لابد وأن تنصرف تماما نحو بنية المسرعات (GPUs/NPUs) وكروت التعامل الذكي مع الشبكات (DPUs) كقادة للعمليات الحاسوبية الثقيلة من ابتكارات وهندسة ورسم وإخراج محتوى وتحليل بيانات ضخمة، تاركة المعالجات القديمة لمهام إدارية خفيفة. وما لم تؤسس غرف تبريد قادرة على كبح العواصف الحرارية للمكونات الجديدة، فلن تكون هذه التوسعات سوى تجميع لنفايات إلكترونية فارهة على الأرض.

معرض الصور