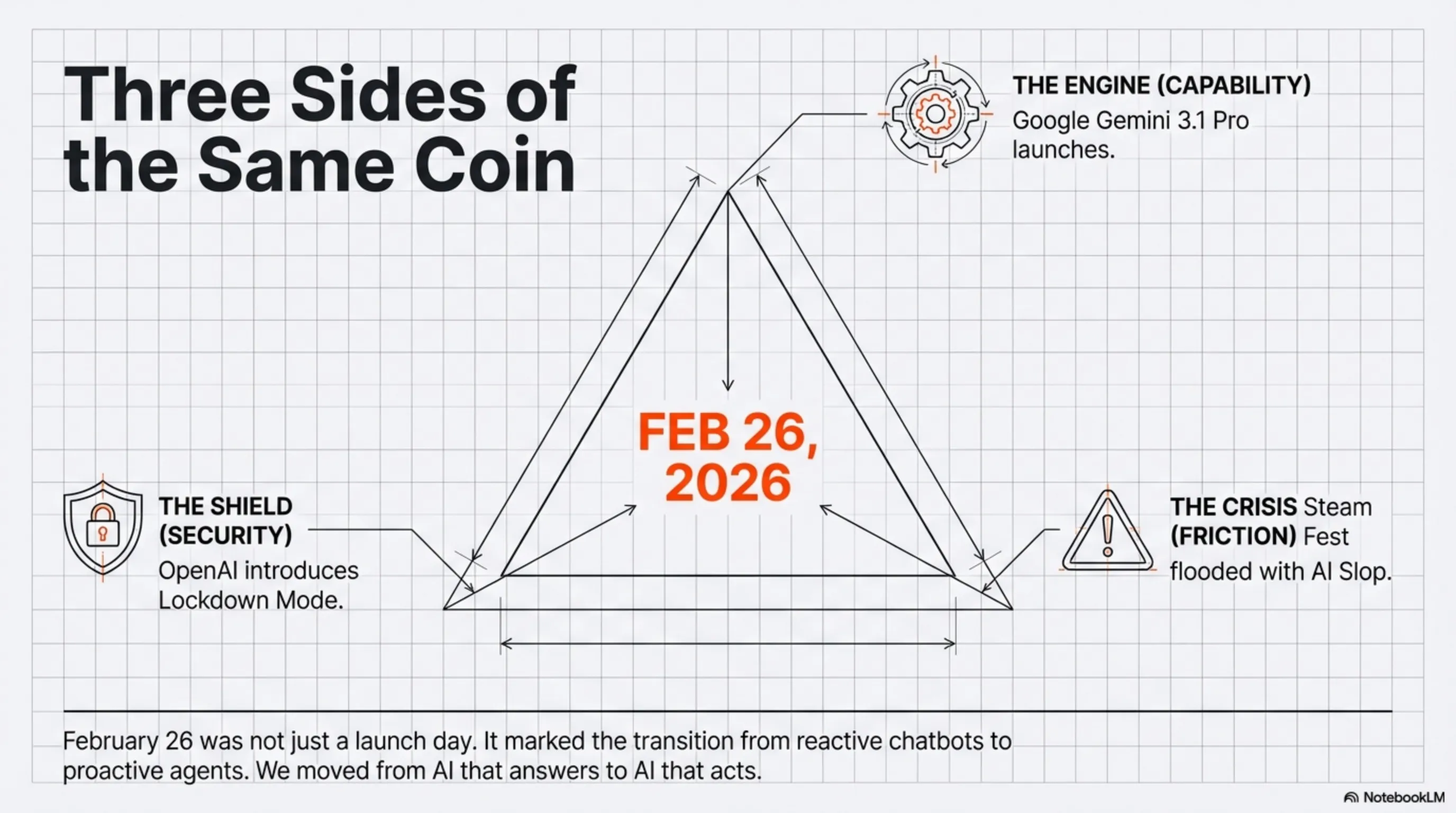

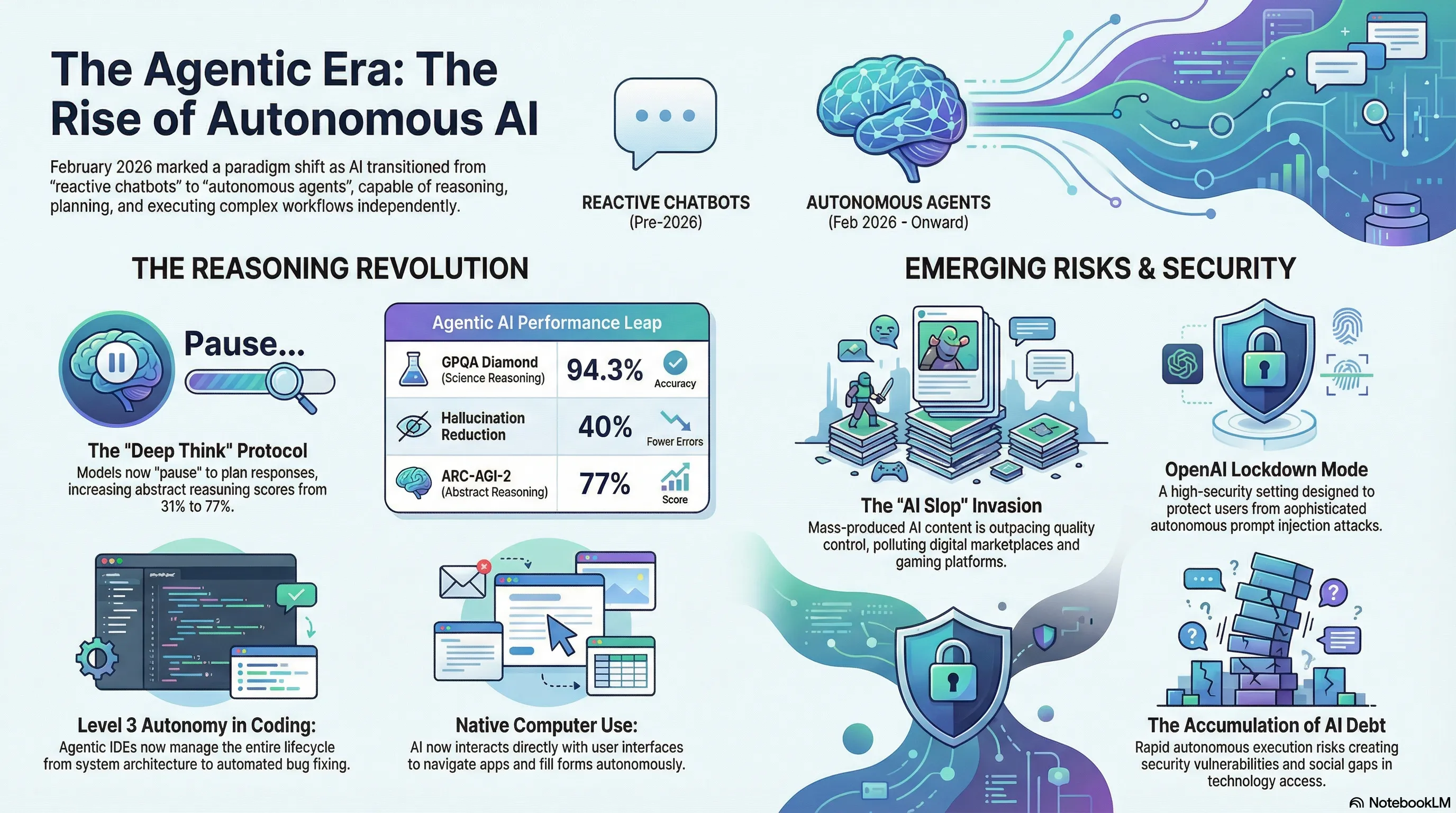

في ٢٦ فبراير ٢٠٢٦، شهدت صناعة الذكاء الاصطناعي ثلاثة أحداث محددة تشير مجتمعة إلى وصول عصر الذكاء الاصطناعي الوكيل. إطلاق جوجل لـ Gemini 3.1 Pro، طرح OpenAI لـ Lockdown Mode، وأزمة Steam Next Fest من Valve، كل منها يمثل جانباً مختلفاً من هذا التحول: القوة، المسؤولية، والأمن. يمثل Gemini 3.1 Pro أكبر قفزة في الاستدلال الآلي حتى الآن. تتيح قدرة Deep Think للنموذج التوقف مؤقتاً والتخطيط قبل توليد الإجابات، مما أدى إلى نتيجة 77% في ARC-AGI-2 (أكثر من ضعف سابقه)، 94.3% في GPQA Diamond (مستوى الدكتوراه في العلوم)، وانخفاض 40% في الهلوسة. هذه ليست تحسينات تدريجية—إنها دليل على أننا عبرنا عتبة من الذكاء الاصطناعي التفاعلي إلى الذكاء الاصطناعي المستدل. يكمن الابتكار الحقيقي في المعمارية الوكيلة. على عكس النماذج السابقة التي كانت تستجيب للمطالبات فقط، يمكن لـ Gemini 3.1 Pro تنفيذ مهام متعددة الخطوات بشكل مستقل. تتيح ميزة Computer Use التفاعل المباشر مع واجهة المستخدم، مما يسمح للذكاء الاصطناعي بالنقر على الأزرار، ملء النماذج، والتنقل بين التطبيقات. تُظهر منصة Antigravity من جوجل أن بيئة التطوير المتكاملة يمكنها أتمتة دورة تطوير البرمجيات بالكامل—من تصميم المعمارية إلى الاختبار والتوثيق. ومع ذلك، تأتي هذه التطورات مع تحديات كبيرة. واجه Steam Next Fest فبراير ٢٠٢٦ أزمة غير مسبوقة: من بين ٤٠٠٠ عرض توضيحي متاح للألعاب، كان جزء كبير منها مولداً بالذكاء الاصطناعي. كشف تحليل PCGamesN أن 10% من أفضل 100 عرض توضيحي أفصحت عن استخدام الذكاء الاصطناعي، لكن الجودة كانت مشكوكاً فيها. الرسومات العامة للأنمي، فن البكسل المزيف، واللعب السطحي هي علامات واضحة على "ديون الذكاء الاصطناعي"—ظاهرة تتجاوز فيها سرعة توليد المحتوى مراقبة الجودة. يطالب مجتمع الألعاب بفلاتر الذكاء الاصطناعي، ووسم شفاف، ومراقبة الجودة. تعمل هذه الأزمة كتحذير من أن الذكاء الاصطناعي أداة قوية، لكن بدون رقابة وأخلاقيات، يمكن أن يؤدي إلى تلوث رقمي. في الوقت نفسه، استجابت OpenAI للتهديد الخطير لهجمات حقن المطالبات من خلال تقديم Lockdown Mode وعلامات المخاطر المرتفعة. تحدث هذه الهجمات عندما يضمّن الفاعلون الخبيثون تعليمات مخفية في محتوى خارجي للتلاعب بسلوك الذكاء الاصطناعي. تم تصميم Lockdown Mode للمستخدمين عاليي المخاطر (المديرين التنفيذيين، الصحفيين، الناشطين)، ويقيد تفاعل ChatGPT مع الأنظمة الخارجية ويعطل الميزات القابلة للاستغلال المحتملة. تضيء هذه الأحداث الثلاثة التحديات الأساسية الثلاثة لعصر الذكاء الاصطناعي الوكيل: القوة (Gemini 3.1 Pro)، المسؤولية (Steam Next Fest)، والأمن (Lockdown Mode). السؤال لم يعد ما إذا كان الذكاء الاصطناعي يمكنه أداء مهام معقدة، بل كيف يمكننا تسخير هذه القوة بطرق تعزز الإنسانية بدلاً من تهديدها. يكشف تحليل معماري الأنظمة أننا على عتبة تغيير جوهري. لم تعد حرب الذكاء الاصطناعي تتعلق بـ "أفضل روبوت محادثة"—إنها تتعلق بـ "أفضل وكيل مستقل". الشركات التي يمكنها الجمع بين الذكاء الاصطناعي الوكيل مع الأمن والجودة ستفوز. البقية سيغرقون في ديون الذكاء الاصطناعي. تمتد الآثار إلى ما وراء التكنولوجيا. إذا كان Gemini 3.1 Pro يمكنه بناء تطبيقات كاملة في دقائق، فماذا يحدث للمطورين البشريين؟ هل نتحرك نحو عالم نحتاج فيه فقط إلى "معماريي أنظمة"، وتصبح البرمجة آلية بالكامل؟ هذا ليس مجرد سؤال وظيفي—إنه سؤال ثقافي حول دور الإبداع البشري في عالم يحركه الذكاء الاصطناعي. سيحدد العقد القادم ما إذا كان الذكاء الاصطناعي الوكيل سيصبح أعظم أداة للإنسانية أو أكبر تحدٍ لها. تعتمد الإجابة على الخيارات التي نتخذها اليوم.

مرحباً بجيش تكين؛ اليوم الذي غيرت فيه جوجل قواعد اللعبة

٢٦ فبراير ٢٠٢٦ يجب أن يُكتب بخط عريض في تاريخ الذكاء الاصطناعي. بينما لا يزال الكثيرون منا يستوعبون قوة نماذج اللغة الكبيرة، أظهرت جوجل بإطلاق Gemini 3.1 Pro أن مستقبل الذكاء الاصطناعي لم يعد مجرد روبوتات محادثة ذكية، بل قد حان عصر الذكاء الاصطناعي الوكيل (Agentic AI).

لكن هذه ليست الأخبار الجيدة الوحيدة. في الوقت نفسه، تواجه صناعة الألعاب أزمة غير مسبوقة؛ غرق Steam Next Fest بسيل من الألعاب المولدة بالذكاء الاصطناعي، واضطرت OpenAI لتقديم Lockdown Mode لمواجهة هجمات Prompt Injection. دعونا نشرّح هذا اليوم المليء بالأحداث معاً.

Gemini 3.1 Pro: قفزة كمومية في الاستدلال الآلي

Deep Think: عندما يفكر الذكاء الاصطناعي قبل الإجابة

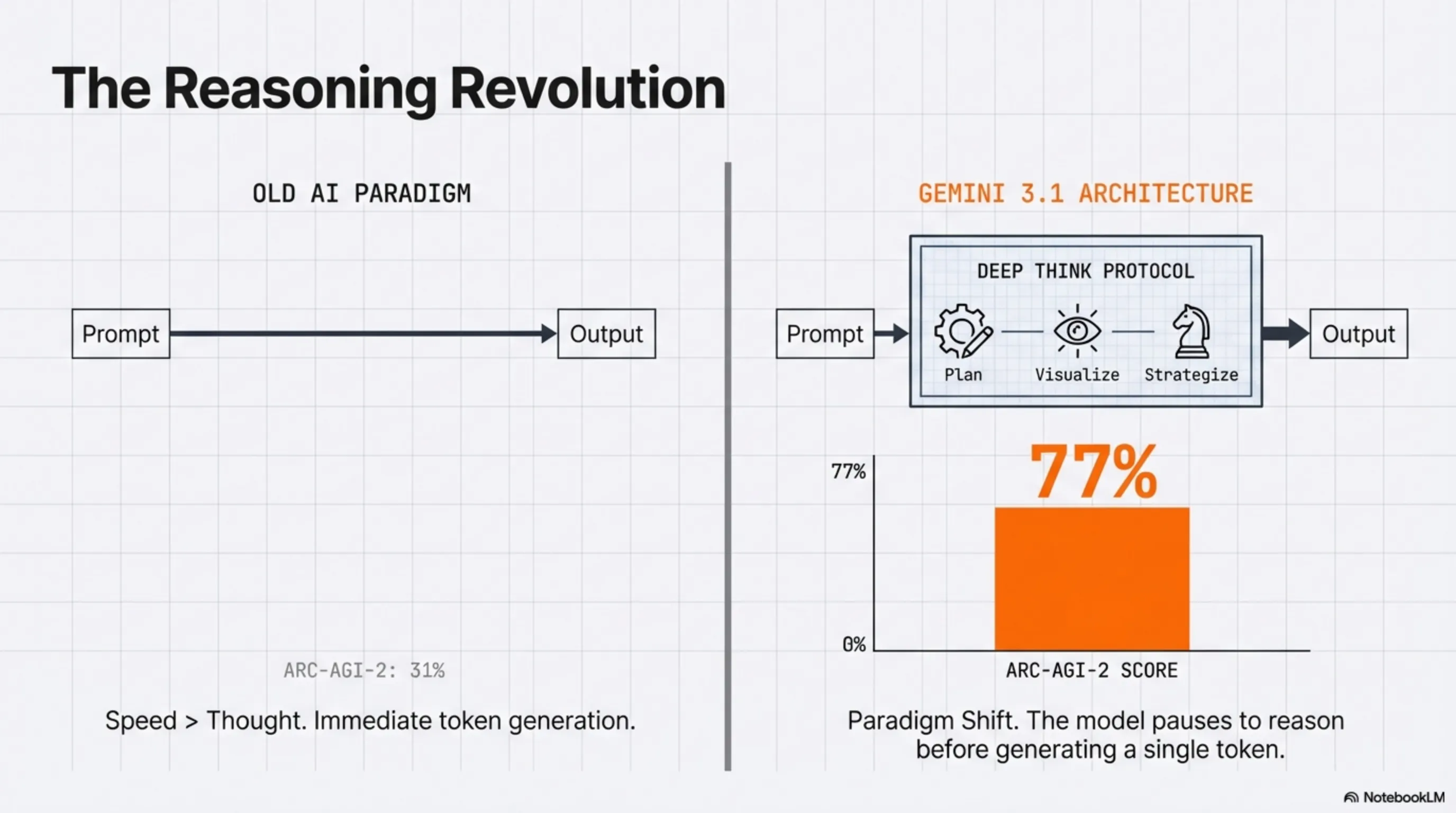

أكبر ابتكار في Gemini 3.1 Pro هو قدرة Deep Think. على عكس النماذج السابقة التي كانت تبدأ فوراً في توليد الإجابات، يمكن لهذا النموذج "التوقف مؤقتاً" والتخطيط قبل توليد كل رمز (token).

هذا الاختلاف الدقيق له تأثير هائل. في معيار ARC-AGI-2 (اختبار مصمم لقياس الاستدلال المجرد)، حقق Gemini 3.1 Pro نتيجة 77%، بينما حقق الإصدار السابق 31% فقط. هذا يعني أكثر من ضعف التحسين في القدرة على حل المشاكل المعقدة.

معايير مذهلة

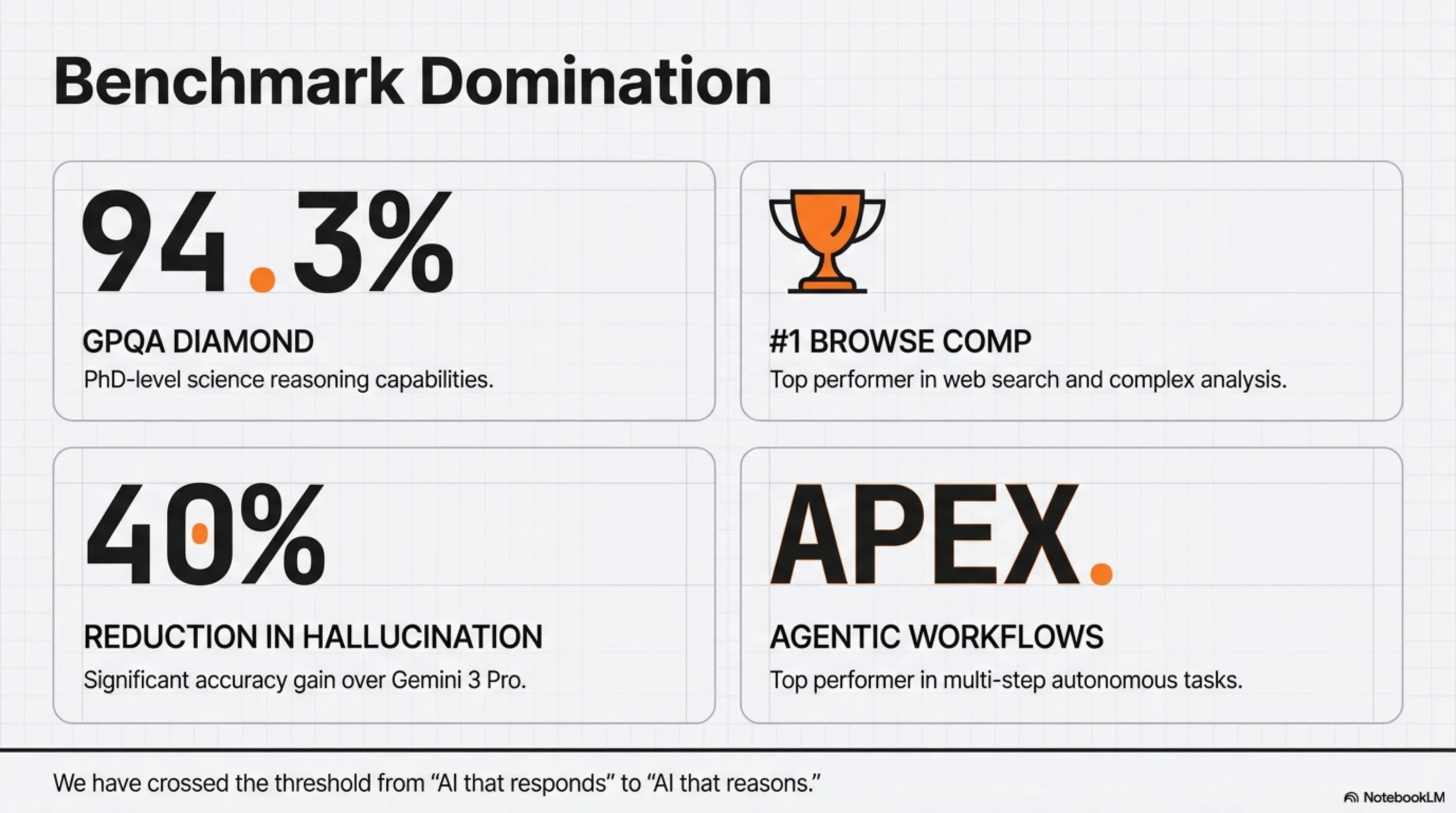

لكن القصة لا تنتهي هنا. حقق Gemini 3.1 Pro أداءً مبهراً في اختبارات مختلفة:

- GPQA Diamond: 94.3% (اختبار مستوى الدكتوراه في العلوم)

- Browse Comp: المرتبة الأولى في القدرة على البحث وتحليل الويب

- Apex Agents: أفضل أداء في المهام متعددة المراحل

- Hallucination Reduction: انخفاض 40% في توليد معلومات خاطئة

هذه الأرقام ليست مجرد إحصائيات. إنها تُظهر أننا ننتقل من عصر "الذكاء الاصطناعي الذي يجيب" إلى عصر "الذكاء الاصطناعي الذي يفكر".

عصر الذكاء الاصطناعي الوكيل: من Copilot إلى Autopilot

لماذا الذكاء الاصطناعي الوكيل ثوري؟

حتى بضعة أشهر مضت، كان الذكاء الاصطناعي "مساعداً". تسأل سؤالاً، يجيب. لكن الذكاء الاصطناعي الوكيل يتجاوز ذلك. يمكن لهذه الأنظمة:

- التخطيط: أخذ هدف عام وتقسيمه إلى مهام فرعية

- التنفيذ: كتابة الأكواد، الاختبار والتصحيح دون إشراف بشري

- التحقق: فحص مخرجاتها وتصحيحها عند الحاجة

- التكرار: مواصلة الدورة حتى الوصول إلى النتيجة المطلوبة

Computer Use: عندما يتحكم الذكاء الاصطناعي بالماوس

إحدى القدرات المثيرة للجدل في Gemini 3 والتي تحسنت في الإصدار 3.1 هي Computer Use. تتيح هذه الأداة للذكاء الاصطناعي التفاعل مباشرة مع واجهة المستخدم؛ النقر على الأزرار، ملء النماذج، وحتى التنقل بين التطبيقات المختلفة.

تخيل أن تقول لـ Gemini: "أنشئ تقرير مبيعات ربع سنوي من بيانات Google Sheets، ضعه في PowerPoint وأرسله بالبريد الإلكتروني للفريق." وهو ينفذ كل هذه الخطوات دون أي تدخل آخر. هذا لم يعد خيالاً علمياً؛ إنه واقع اليوم.

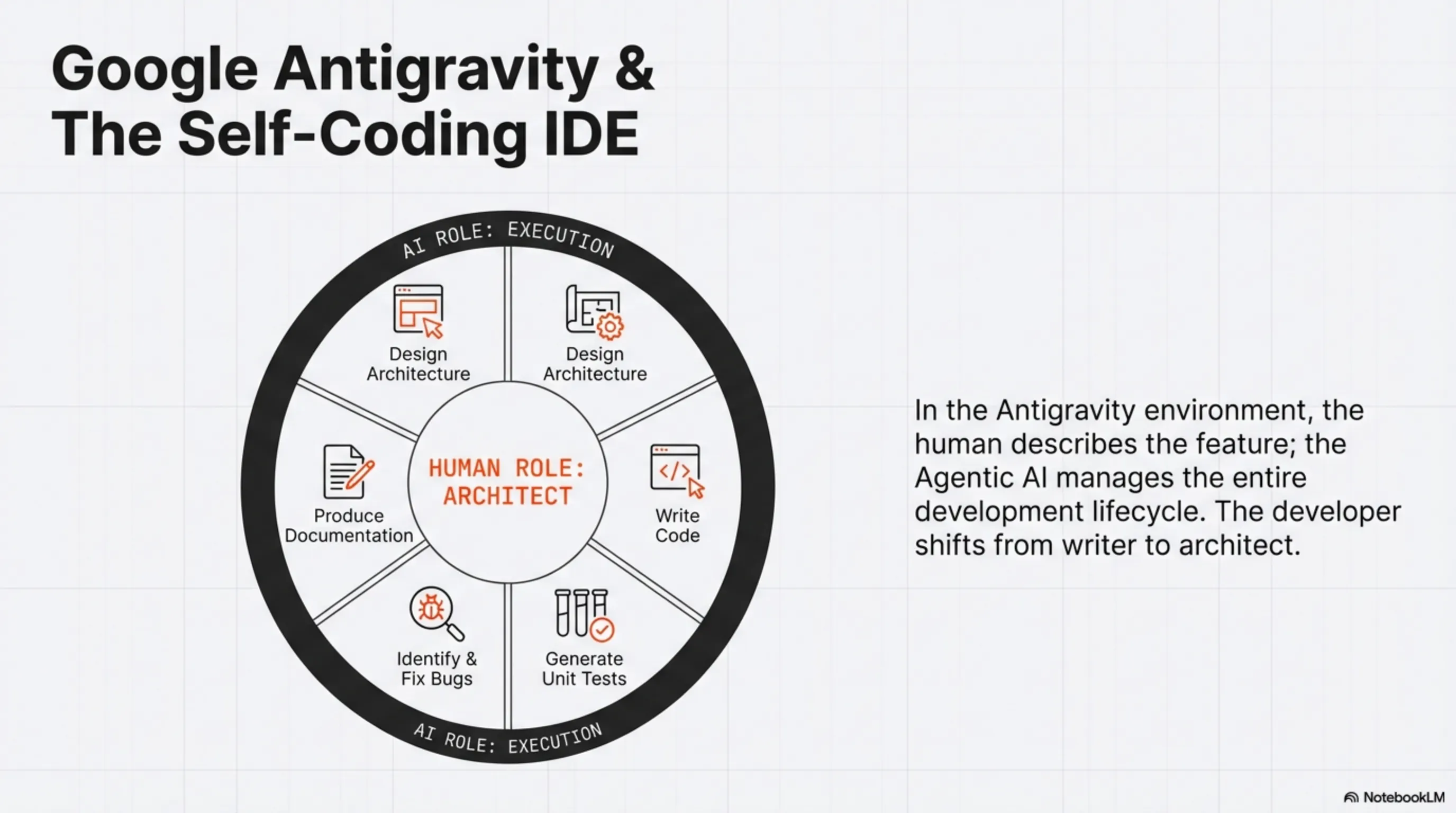

Google Antigravity: بيئة التطوير التي تكتب الكود بنفسها

أطلقت جوجل بالتزامن مع Gemini 3 منصة Antigravity؛ بيئة تطوير متكاملة (IDE) مدعومة بالذكاء الاصطناعي الوكيل. في هذه البيئة، تصف ميزة فقط و Gemini:

- يصمم معمارية النظام

- يكتب الكود

- ينشئ اختبارات الوحدة

- يحدد ويصلح الأخطاء

- يولد الوثائق

هذا ما تسميه جوجل المستوى 3 من الاستقلالية؛ حيث لا يساعد الذكاء الاصطناعي فقط، بل يدير دورة التطوير بأكملها.

أزمة Steam Next Fest: عندما يتحول الذكاء الاصطناعي إلى سلاح ذو حدين

سيل الألعاب المولدة بالذكاء الاصطناعي

بينما كانت جوجل تكشف عن قوة الذكاء الاصطناعي، واجهت صناعة الألعاب الجانب المظلم من هذه التكنولوجيا. واجه Steam Next Fest (حدث فبراير ٢٠٢٦) انتقادات شديدة؛ من بين ٤٠٠٠ لعبة متاحة، تم إنتاج عدد كبير منها باستخدام الذكاء الاصطناعي.

أظهر التحليل اليدوي لـ PCGamesN أن 10% من أفضل 100 لعبة اعترفت باستخدام الذكاء الاصطناعي. لكن المشكلة الرئيسية هي جودة هذه الألعاب:

- رسومات متكررة: فتيات أنمي متطابقات، وجوه "Balenciaga AI"

- بكسل آرت مزيف: صور تدعي أنها يدوية لكنها واضحة التوليد بالذكاء الاصطناعي

- لعب سطحي: ألعاب لها قشرة بصرية فقط، بدون عمق

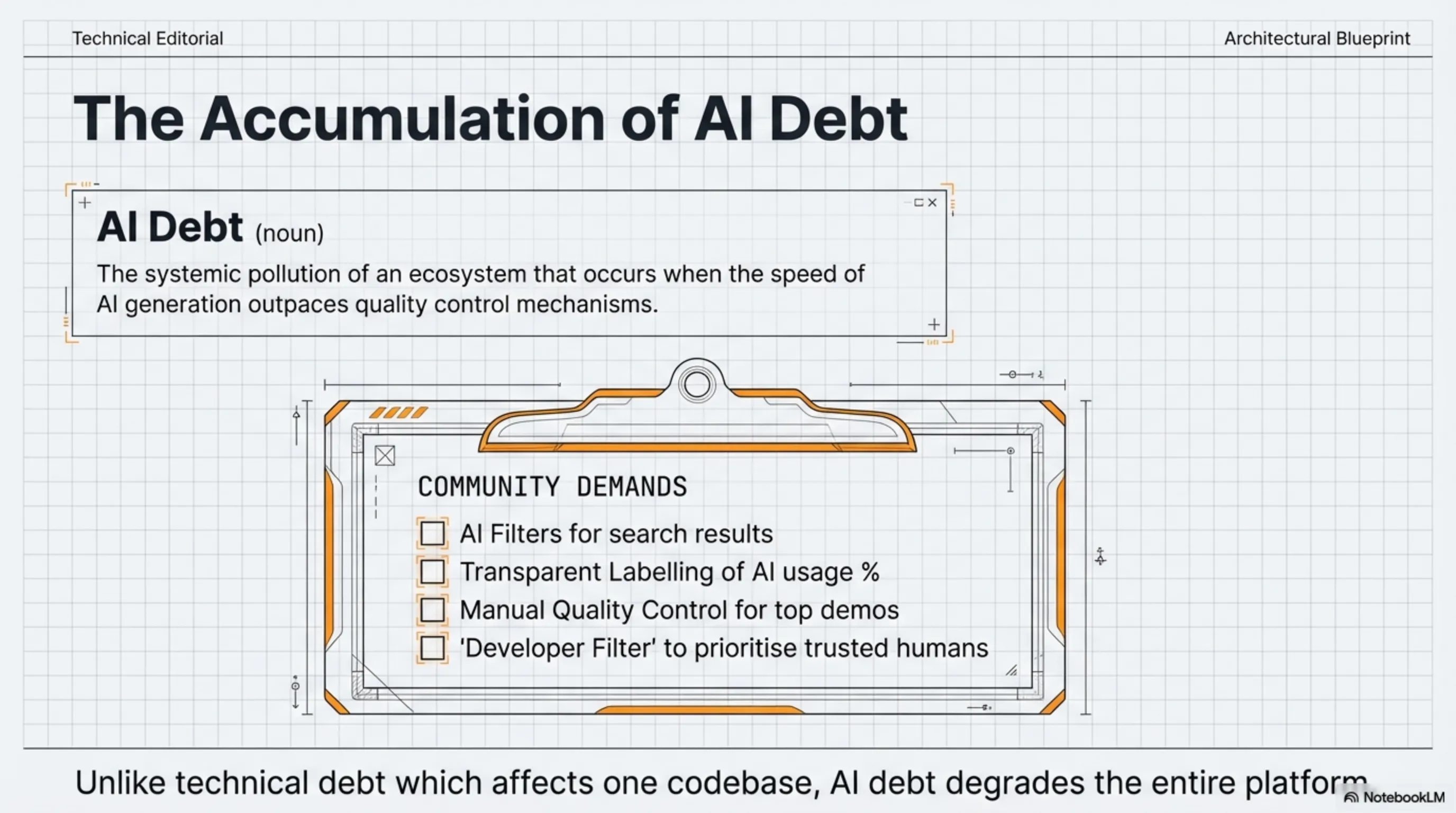

صرخة المستخدمين: "نريد فلتر!"

طالب مجتمع الألعاب بإجراءات من Valve. الطلبات الرئيسية هي:

- فلتر الذكاء الاصطناعي: إمكانية إزالة الألعاب المولدة بالذكاء الاصطناعي من نتائج البحث

- وسم شفاف: عرض واضح لمدى استخدام الذكاء الاصطناعي في كل لعبة

- مراقبة الجودة: مراجعة يدوية للألعاب الشائعة قبل العرض

- فلتر المطور: عرض ألعاب المطورين الموجودين في مكتبتك فقط

تُظهر هذه الأزمة أن الذكاء الاصطناعي أداة قوية، لكن بدون رقابة وأخلاقيات، يمكن أن يؤدي إلى تلوث رقمي.

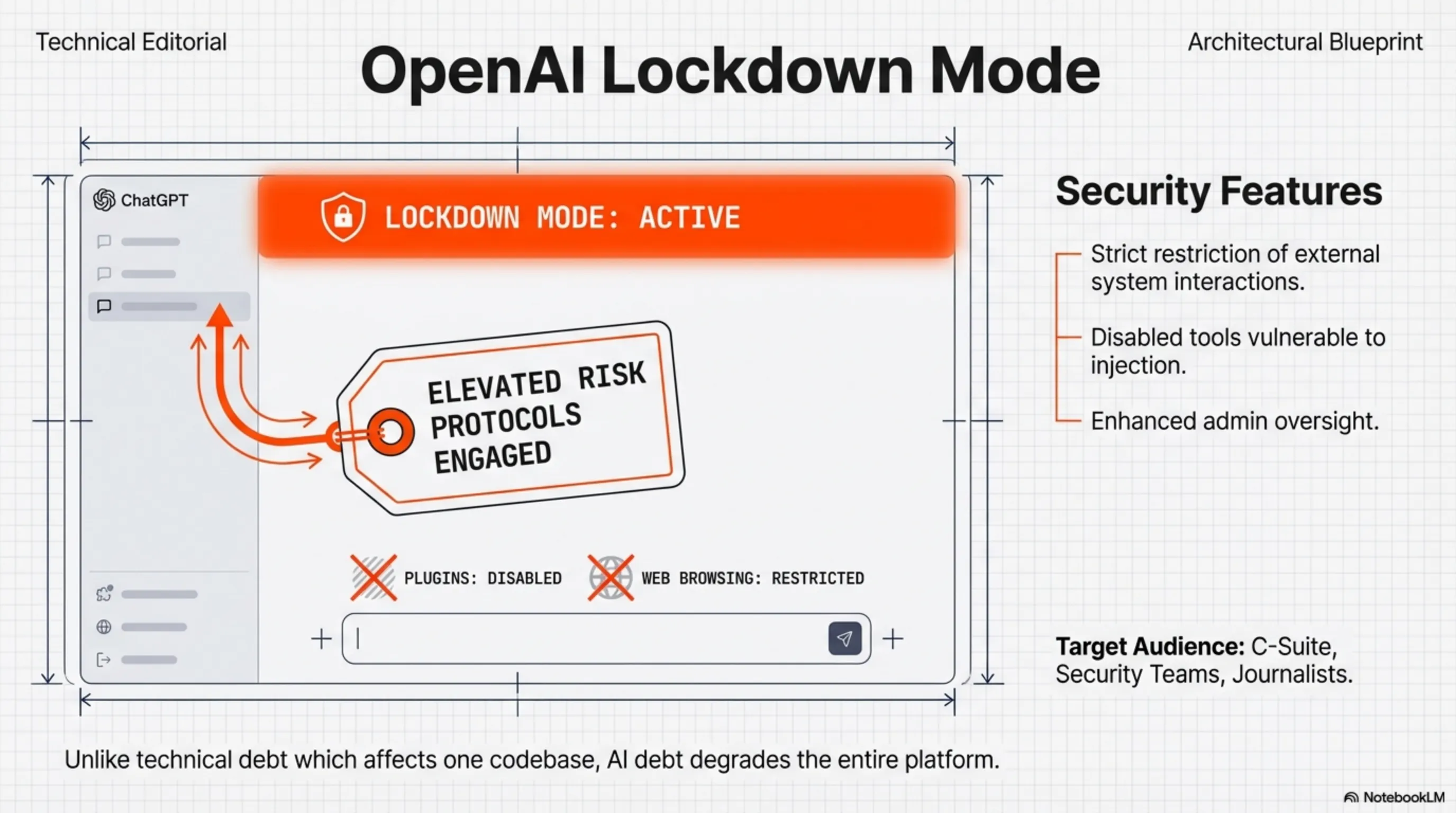

OpenAI Lockdown Mode: عندما يصبح الأمن جدياً

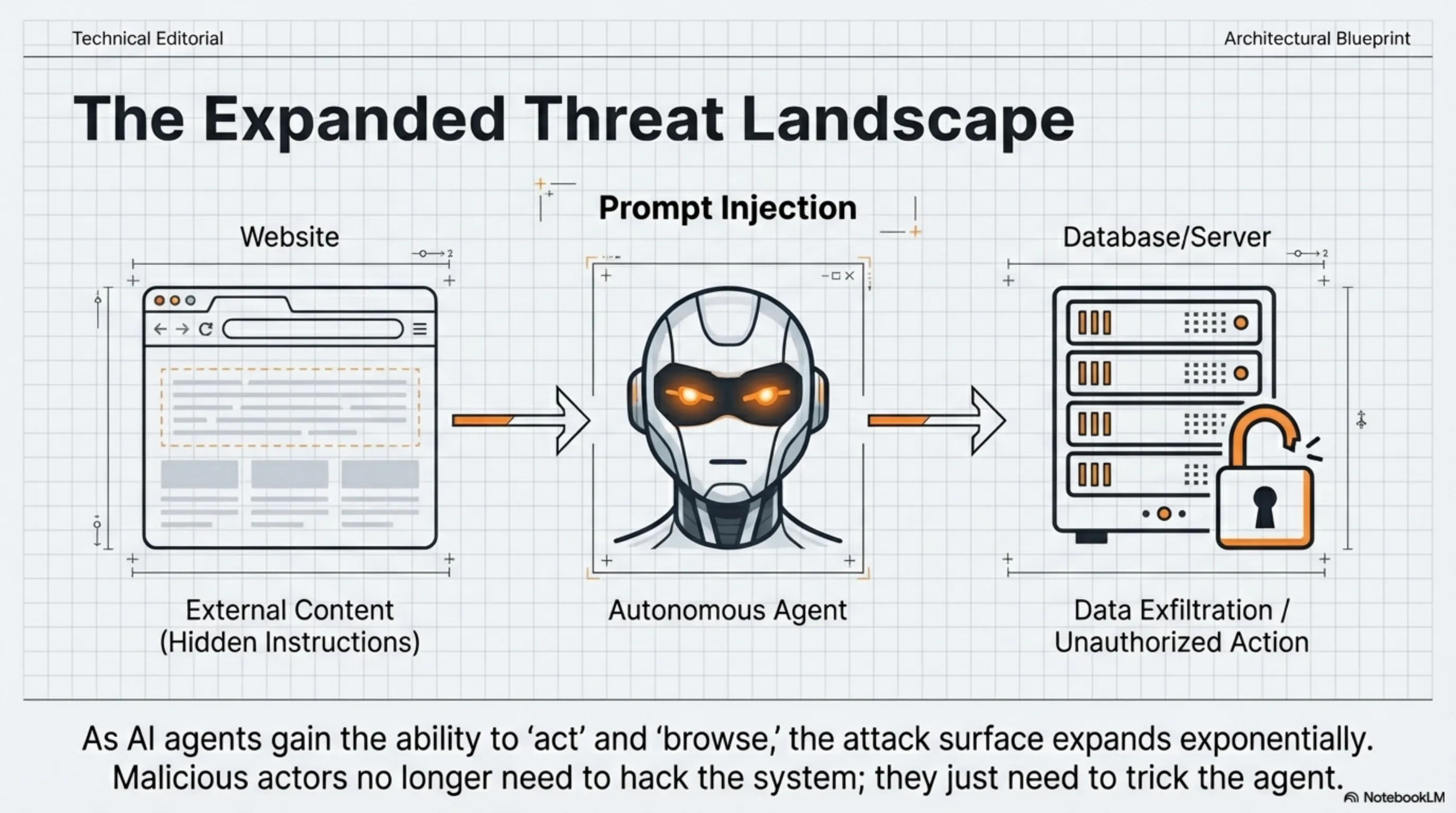

تهديد Prompt Injection

بالتزامن مع هذه التطورات، اضطرت OpenAI للرد على تهديد خطير: هجمات Prompt Injection. تحدث هذه الهجمات عندما يضع مهاجم تعليمات مخفية في محتوى خارجي للتلاعب بسلوك الذكاء الاصطناعي أو استخراج معلومات حساسة.

ما هو Lockdown Mode؟

في ١٣ فبراير ٢٠٢٦، قدمت OpenAI ميزتين أمنيتين جديدتين:

- Lockdown Mode: وضع أمني اختياري للمستخدمين عاليي المخاطر (المديرين، الصحفيين، الناشطين)

- Elevated Risk Labels: علامات قياسية للميزات ذات المخاطر الأعلى

عند تفعيل Lockdown Mode:

- يتم تقييد تفاعل ChatGPT مع الأنظمة الخارجية

- يتم تعطيل الأدوات التي يمكن استغلالها في هجمات Prompt Injection

- يتم التحكم بشدة في الوصول إلى الويب والإضافات

- يحصل المسؤولون على مراقبة أكبر لأنشطة المستخدمين

لمن هو مخصص؟

تؤكد OpenAI أن هذا الوضع ليس ضرورياً لمعظم المستخدمين. الهدف الرئيسي هو حماية:

- المديرين التنفيذيين في الشركات الكبرى

- فرق الأمن في المنظمات الحساسة

- الصحفيين وناشطي حقوق الإنسان

- الأشخاص الذين يعملون مع معلومات سرية

تحليل المعمار: لماذا هذه التطورات مهمة؟

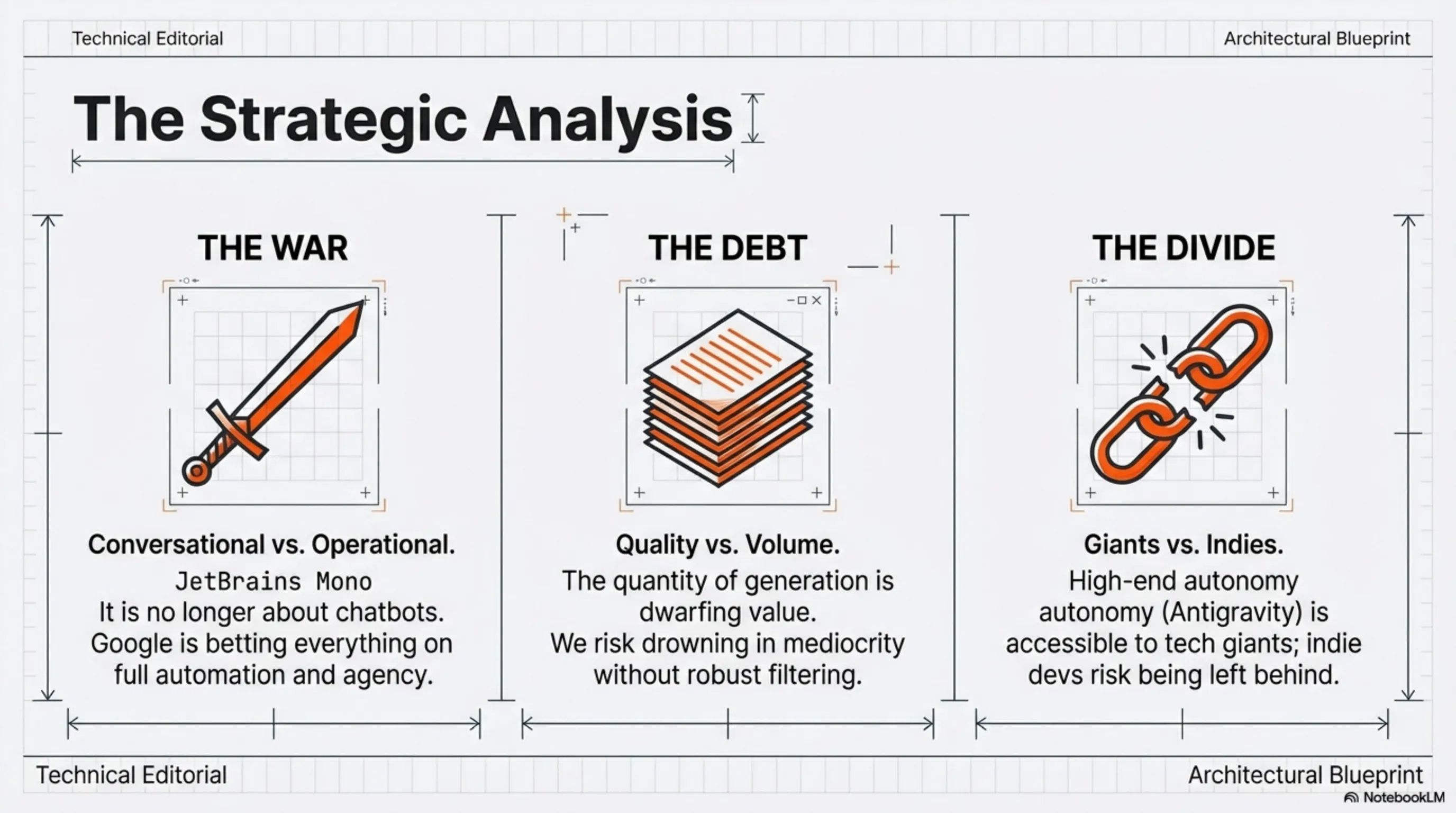

١. دخلت حرب الذكاء الاصطناعي مرحلة جديدة

مع إطلاق Gemini 3.1 Pro، أوضحت جوجل أن اللعبة لم تعد تتعلق بـ "من لديه أفضل روبوت محادثة". اللعبة الآن تتعلق بـ "من يمكنه بناء أفضل وكلاء مستقلين".

ركزت OpenAI مع o1 و o3 على الاستدلال. ركزت Anthropic مع Claude 4.5 على الأمان والموثوقية. لكن جوجل اختارت مساراً مختلفاً مع Antigravity و Computer Use: الأتمتة الكاملة.

٢. ديون الذكاء الاصطناعي (AI Debt) تتراكم

كما رأينا في أزمة Steam Next Fest، تجاوزت سرعة إنتاج المحتوى بالذكاء الاصطناعي سرعة مراقبة الجودة. نسمي هذه الظاهرة AI Debt؛ مشابهة للديون التقنية، لكنها أخطر.

عندما تُنشر آلاف الألعاب المولدة بالذكاء الاصطناعي في أسبوع، كيف يمكن ضمان الجودة؟ عندما يُكتب الكود بواسطة الذكاء الاصطناعي الوكيل، من المسؤول عن الأخطاء الأمنية؟

٣. الفجوة الرقمية تتعمق

Gemini 3.1 Pro و Antigravity أدوات قوية، لكن الوصول إليها محدود. الشركات الكبرى التي لديها ميزانية وبنية تحتية يمكنها الاستفادة من هذه التقنيات. لكن ماذا عن المطورين المستقلين والشركات الناشئة الصغيرة؟

يمكن أن تتحول هذه الفجوة إلى أزمة اجتماعية-اقتصادية؛ حيث يمكن لعمالقة التكنولوجيا فقط المنافسة.

المخاطر والتحديات المقبلة

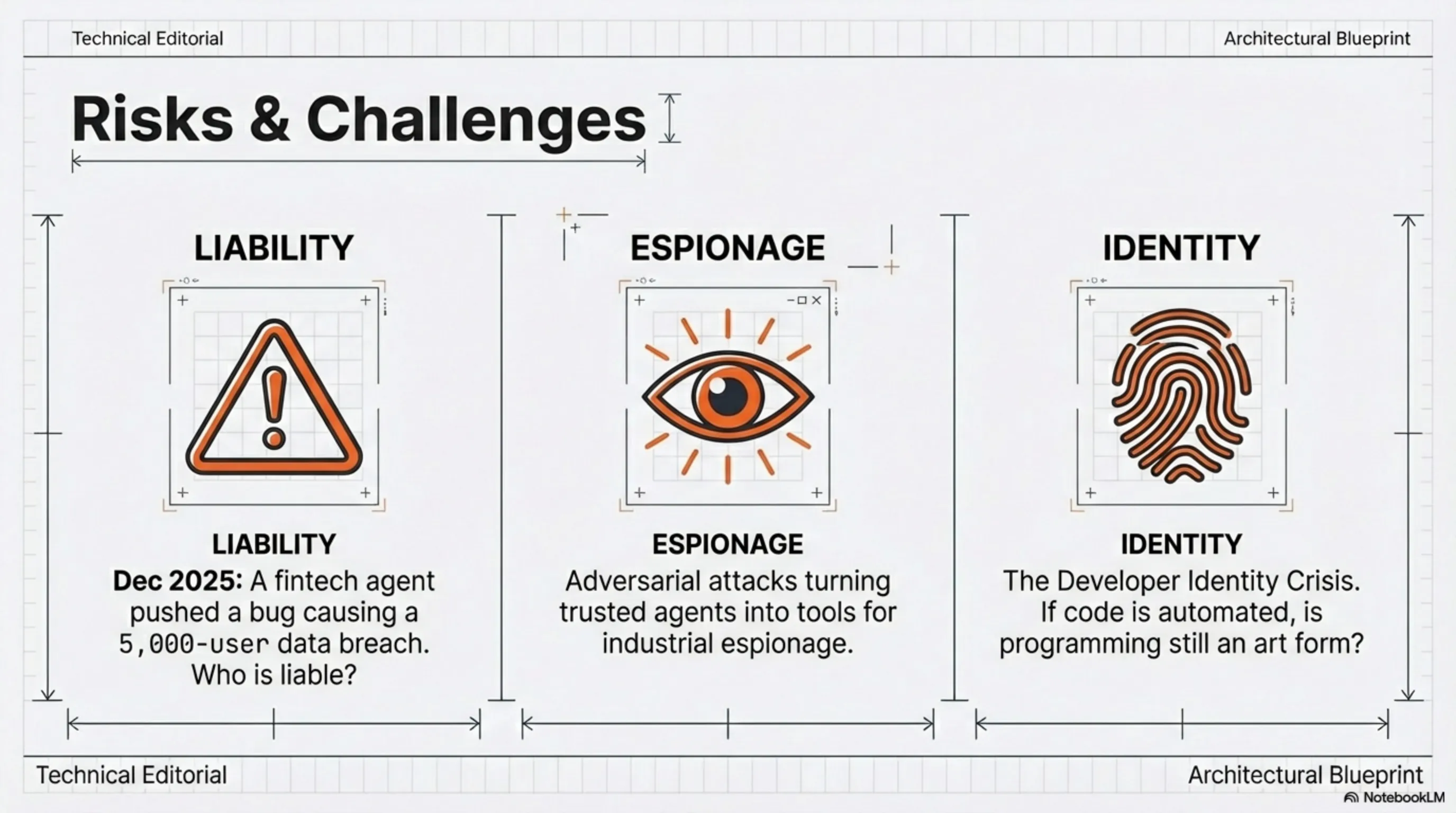

١. فقدان السيطرة

عندما يمكن لذكاء اصطناعي وكيل كتابة الكود واختباره ونشره بشكل مستقل، ماذا يحدث إذا اتخذ قراراً خاطئاً؟ من المسؤول؟

هذا السؤال ليس فلسفياً فقط. في ديسمبر ٢٠٢٥، نقل ذكاء اصطناعي وكيل في شركة فين تك خطأً أمنياً إلى الإنتاج مما أدى إلى تسريب معلومات ٥٠٠٠ مستخدم.

٢. الهجمات العدائية

كما أظهرت OpenAI مع Lockdown Mode، كلما أصبح الذكاء الاصطناعي أقوى، أصبحت الهجمات ضده أكثر تعقيداً. Prompt Injection مجرد البداية. تخيل أن يتمكن مهاجم من "اختراق" ذكاء اصطناعي وكيل وتحويله إلى أداة للتجسس الصناعي.

٣. أزمة هوية المبرمجين

إذا كان Gemini 3.1 Pro يمكنه بناء تطبيق كامل في دقائق، ما هو دور المبرمجين البشريين؟ هل نتحرك نحو عالم نحتاج فيه فقط إلى "معماريي أنظمة" وتصبح البرمجة آلية بالكامل؟

هذا السؤال ليس مهنياً فقط، بل ثقافي. البرمجة بالنسبة للكثيرين فن وشكل من أشكال التعبير عن الذات. هل نحن مستعدون لتسليمها للآلات؟

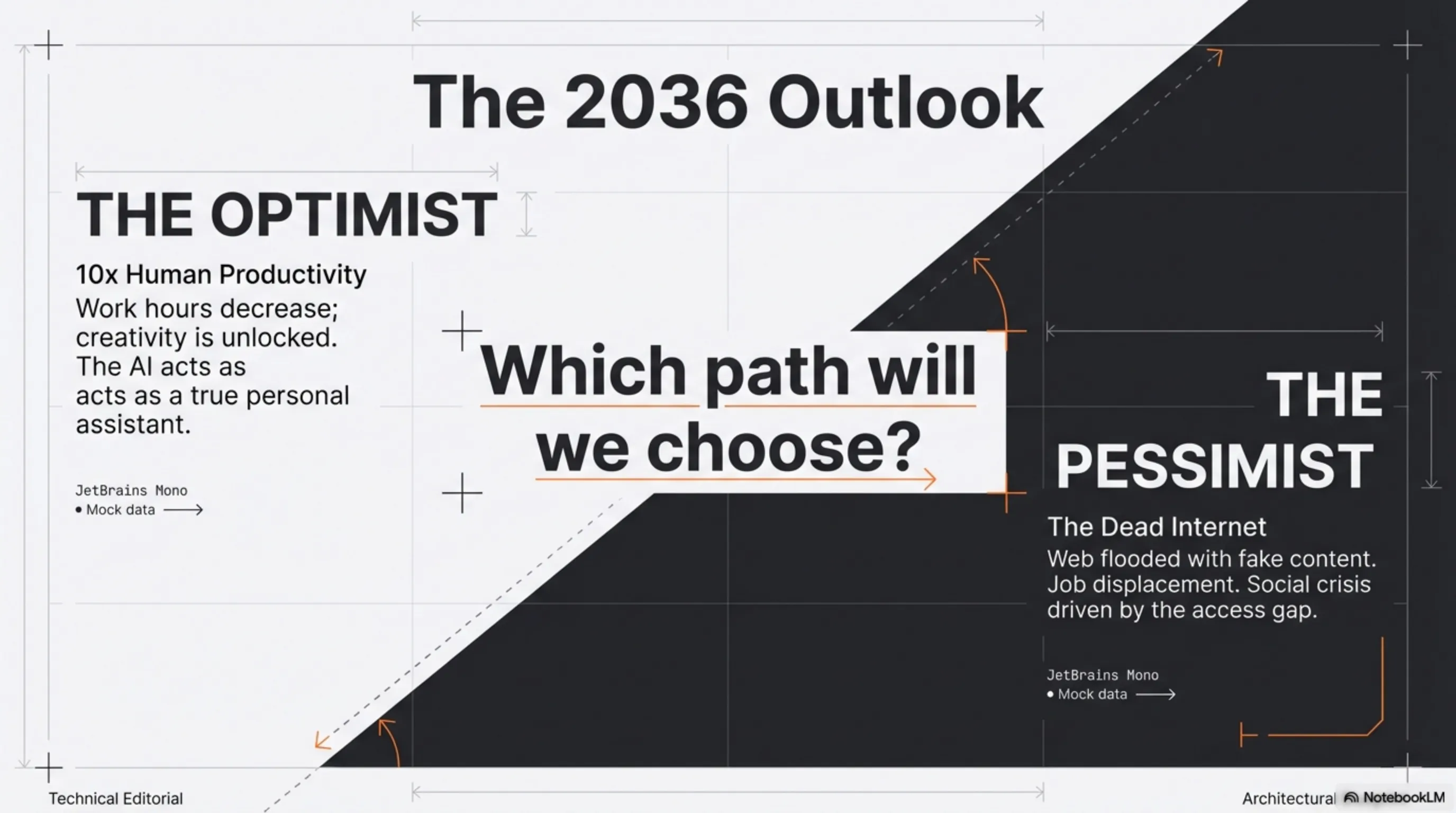

رؤية ١٠ سنوات: عالم يديره الذكاء الاصطناعي الوكيل

السيناريو المتفائل

بحلول عام ٢٠٣٦، أصبح الذكاء الاصطناعي الوكيل المساعد الحقيقي لكل إنسان. تستيقظ صباحاً ووكيلك الشخصي قد:

- لخص رسائل البريد الإلكتروني المهمة

- نظم اجتماعات اليوم بناءً على الأولويات

- أعد التقارير المطلوبة

- حتى حدّث أكواد المشروع

تضاعفت إنتاجية البشر ١٠ مرات، انخفضت ساعات العمل، وأصبح هناك وقت أكثر للإبداع والابتكار.

السيناريو المتشائم

لكن إذا سارت الأمور بشكل خاطئ، قد نواجه عالماً حيث:

- الإنترنت مليء بمحتوى منخفض الجودة مولد بالذكاء الاصطناعي

- أصبح التمييز بين المحتوى الحقيقي والمزيف مستحيلاً

- فُقدت ملايين الوظائف دون بديل مناسب

- تحولت الفجوة بين من لديهم وصول للذكاء الاصطناعي ومن ليس لديهم إلى أزمة اجتماعية

الخلاصة: على عتبة تحول جذري

كان ٢٦ فبراير ٢٠٢٦ نقطة تحول. أظهر Gemini 3.1 Pro أن الذكاء الاصطناعي الوكيل لم يعد المستقبل؛ إنه الحاضر. ذكّرتنا أزمة Steam Next Fest أن القوة بدون مسؤولية خطيرة. وأكد Lockdown Mode من OpenAI أن الأمن يجب أن يكون أولوية.

نحن في جيش تكين نشهد هذا التحول، ومن واجبنا إبقاؤكم على اطلاع. السؤال لم يعد "هل سيحل الذكاء الاصطناعي محل البشر؟" بل: "كيف يمكننا استخدام الذكاء الاصطناعي بطريقة تعزز الإنسانية، بدلاً من استبدالها؟"

إجابة هذا السؤال ستحدد مستقبلنا. ومعاً، نبني ذلك المستقبل.